本文提出了一种用于张量网络收缩(Tensor-network contractions)的数值自举(Numerical Bootstrap)框架。通过将收缩问题转化为凸优化问题,该方法能够为物理可观测量的期望值提供严格的置信上下界,并在矩阵乘积态(MPS)上实现了 SOTA 级别的精确精度。

TL;DR

在处理高维张量网络(Tensor Networks)时,物理学家长期受困于“精度焦虑”——现有的收缩算法大多是近似的,没人能保证结果离真值到底差了多少。香港科技大学等机构的研究团队提出了一种基于**数值自举(Numerical Bootstrap)的新框架。通过将收缩过程转化为凸优化(Convex Optimization)**问题,该方法第一次为张量网络提供了严格的上下界。

痛点深挖:消失的置信度

在量子多体物理和统计力学中,张量网络(如 MPS, PEPS)是描述复杂关联态的利器。然而,想要从这些网络中提取物理量(如能量密度、关联函数),就必须面对“收缩(Contraction)”这一关。

- 一维(MPS):收缩是简单的,存在精确解。

- 高维(PEPS):收缩是 NP-Hard 的。

现有的主流算法(如 CTMRG)就像是“摸着石头过河”,虽然大多数时候能过岸,但缺乏物理上的严格性。如果模型处于相变点附近,近似失效了怎么办?这就是本文试图解决的核心动机:我们能否找到一种方法,不给出一个“大概”的值,而是给出一个“确定”的区间?

核心直觉:从“近似态”到“划定禁区”

作者的灵感来自于量子场论中的自举思想。他们没有尝试去寻找那一个最完美的“环境态”(Environment State),而是反其道而行之:

- 定义映射:将张量网络的每一层看作是一个正线性映射(Positive Linear Map)。

- 设定约束:任何真实的物理态必须满足正定性(Positive Semidefiniteness)。

- 自举演化:随着映射的层层传播,物理上可行的环境态空间会不断缩小。

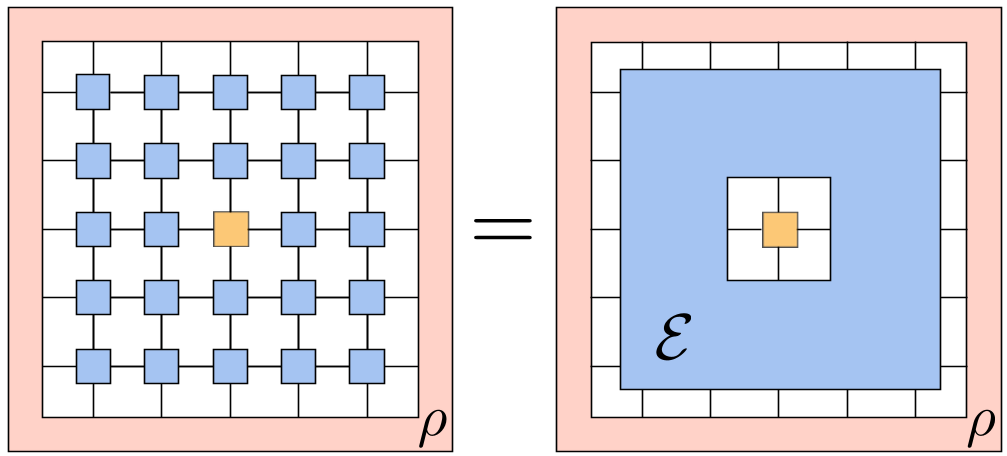

图 1:二维张量网络收缩的示意图。周边张量形成一个线性映射 E,作用在边界算子 ρ 上。

图 1:二维张量网络收缩的示意图。周边张量形成一个线性映射 E,作用在边界算子 ρ 上。

技术亮点:SOC 与 SDP 的博弈

为了让这个“寻找区间”的任务在计算机上可行,作者引入了两种数学工具:

- 二阶锥规划 (SOCP):针对规范型(Canonical Form)的张量网络,利用 Bloch 球在高维空间的推广来划定边界。这种方法计算极快,能处理 bond dimension $\chi$ 较大的情况。

- 半正定规划 (SDP):对于更通用的非规范型网络,使用完整的矩阵正定性约束。虽然计算成本更高,但它能够处理更复杂的边缘状态纠缠。

实验验证:边界的指数收缩

在对翻译对称的 MPS 进行测试时,研究发现随着传播距离 $R$ 的增加,观测量的上下界会迅速向真值靠拢。

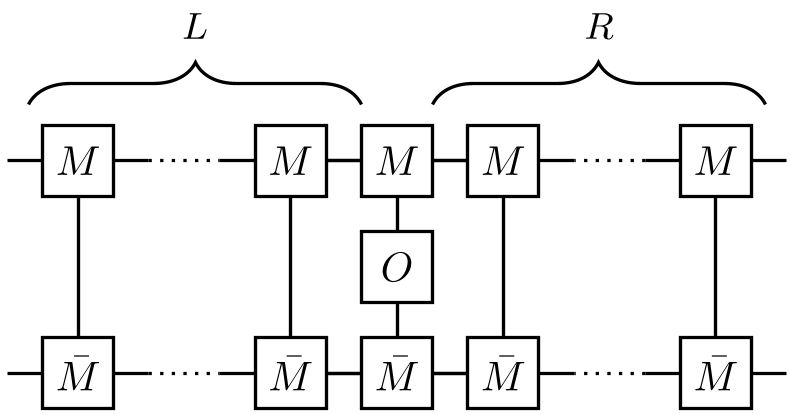

图 3:随着迭代次数增加,参数空间(Bloch 球的投影)迅速缩小,最终锁定真值所在的极小区域。

图 3:随着迭代次数增加,参数空间(Bloch 球的投影)迅速缩小,最终锁定真值所在的极小区域。

深度洞察:它的局限与未来

尽管在 MPS 上表现惊艳,但作者也坦诚地指出了该方法在某些特殊态(如 GHZ 态)下的失效。这是因为 GHZ 态的转移矩阵是非遍历的,导致期望值本身就依赖于边界条件的选取——这反而从侧面证明了自举框架的严谨性:它绝不给出一个无根据的均值,而是诚实地反映出物理上的不确定性。

总结与展望

这篇论文标志着张量网络研究从“经验算法时代”向“严谨认证时代”迈出的一大步。虽然将该方法扩展到大规模 2D 系统还面临计算效率的挑战(SDP 的计算量随维度增长较快),但它为诸如量子算力验证、关键相变点的精确测量提供了一种全新的思路。

启发:在 AI 领域,如果我们将神经网络的层级结构类比为张量网络,是否也能利用类似的自举约束来为模型的可解释性或输出的不确定性提供严格证明?这非常值得跨学科探讨。