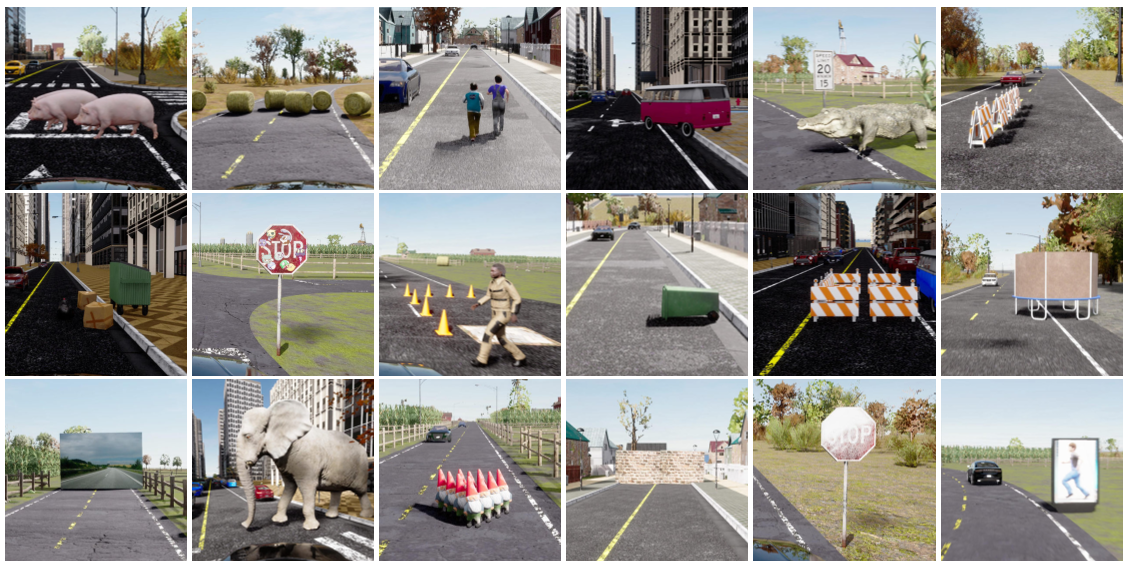

本文推出了 Fail2Drive,它是首个针对 CARLA 模拟器的闭环驾驶泛化性能评测基准。通过引入 17 类涵盖外观、布局和行为偏移的新场景,Fail2Drive 揭示了当前 SOTA 模型在面对长尾分布(OOD)时的脆弱性,平均成功率下降达 22.8%。

TL;DR

尽管自动驾驶模型在 CARLA 排行榜上分数节节攀升,但它们在面对“没见过”的场景时表现如何?由图宾根大学提出的 Fail2Drive 是第一个专门针对闭环驾驶泛化性设计的 Benchmark。通过 200 条成对行驶路线和 17 种全新的干扰场景,Fail2Drive 撕开了 SOTA 模型的“伪装”:在分布偏移(OOD)下,模型平均性能下降超过 22%,甚至会出现无视 LiDAR 信号直接撞向障碍物的离谱行为。

痛点深挖:被模版化“喂”出来的智能

在自动驾驶研究中,CARLA 模拟器是绝对的标配。然而,工业界和学术界长期存在一个被忽视的偏见:测试集与训练集高度重合。

目前的模型在测试时遇到的路段、使用的交通锥桶甚至是行人的外观模型,在训练阶段都已经见过了无数次。在这种环境下,模型往往学会了“走捷径(Shortcut Learning)”:

- 看到某种特定的交通锥 -> 触发换道逻辑。

- 看到特定的行人模型 -> 触发减速。

一旦我们将行人换成一只斑马,或者移除交通锥旁边那个标志性的警示牌,这些模型就会因为找不到“匹配模版”而导致逻辑崩溃。

核心机制:Fail2Drive 的因果隔离设计

Fail2Drive 的核心创新在于其**成对评价(Paired Evaluation)**机制。

- 分布内对照(In-distribution):标准的 CARLA 场景,用于建立性能基准。

- 泛化偏移(Generalization):在同一地点、同一交通状况下,只改变一个变量(例如把卡车换成草堆,或者加入视觉干扰)。

这种设计能直接计算“泛化差距(Generalization Gap)”,让定性的失效变成定量的诊断。

四大泛化类别:

- Robustness(鲁棒性):无关物体(如路边无关的施工队)不应影响驾驶。

- Visual - Lateral(横向视觉):没见过的障碍物是否依然能触发避障?

- Visual - Longitudinal(纵向视觉):没见过的物体(如鳄鱼、猪)过马路,车辆会刹车吗?

- Behavioral(行为泛化):在全路段封死的情况下,模型能否学会原地等待而非强行逆行?

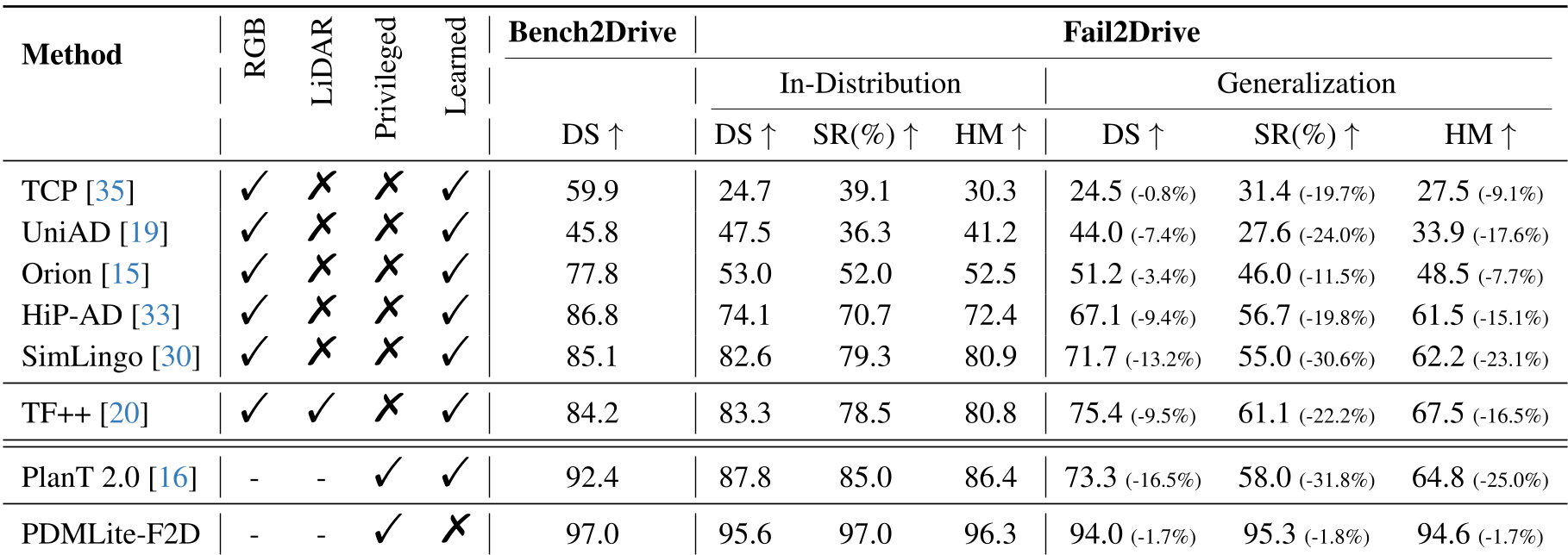

实验结果:全线崩盘的 SOTA

作者评估了包括 TransFuser++ (TF++), UniAD, SimLingo, Orion 在内的七款顶尖模型。

令人大跌眼镜的发现:

- “视觉欺骗”的完胜:在 Wall 场景中(在路面竖起一面印有前方道路照片的墙),所有模型全军覆没。即使是拥有 LiDAR(激光雷达)的模型也视而不见,直接撞墙。这说明模型更相信摄像头的视觉“连通性”而非物理空间的真实占据情况。

- VLM 不是万能药:像 SimLingo 这样基于大语言模型的 VLA 系统,在面对路面上的行人时,竟然会幻觉出“前方有自行车”而导致避让失败。

- 对特权信息的依赖:即便是使用 ground-truth 简化信息的 PlanT 2.0,在移除特定的施工标志后性能也会腰斩,说明其学习的是“标志到动作”的映射,而非“障碍物到动作”的逻辑。

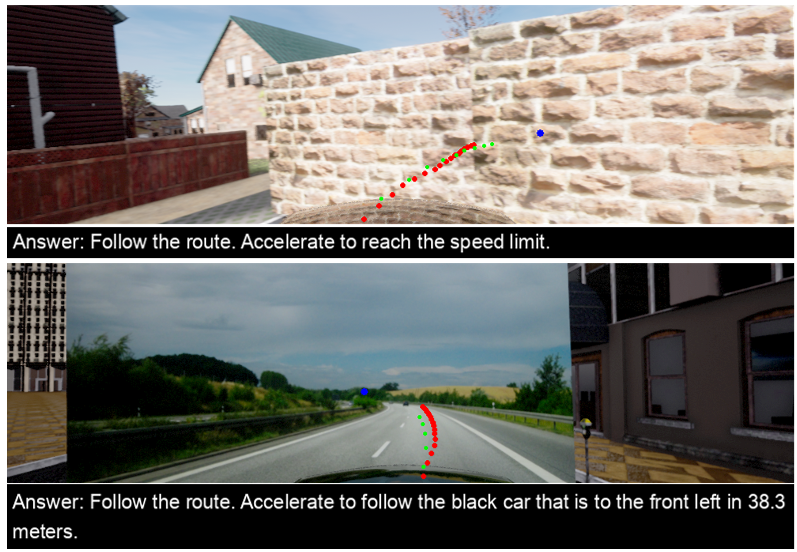

图:TransFuser++ 准确感知到了车辆,但在识别为障碍物后依然预测全力加速,产生逻辑断层。

图:TransFuser++ 准确感知到了车辆,但在识别为障碍物后依然预测全力加速,产生逻辑断层。

深度洞察与总结

Fail2Drive 告诉我们:闭环泛化能力是自动驾驶从实验室走向公开道路的最后一道关卡。

核心总结 (Takeaways):

- 空间逻辑的缺失:目前的模型并未真正理解何为“Drivable Space (可行驶空间)”,它们只是在寻找熟悉的视觉信号。

- Fallback 机制匮乏:模型在遇到不确定的 OOD 场景时,倾向于维持既定车速,缺乏“减速观望”等防御性驾驶常识。

- 工具链价值:Fail2Drive 提供的工具箱补全了 CARLA 在长尾资产上的短板,是后续研究训练鲁棒算法的利器。

未来展望: 未来的研究重心应当从“刷高 CARLA 分数”转向“降低泛化跌幅”。通过 Fail2Drive 提供的成对测试,我们能够更清晰地捕捉模型中存在的 Bias,从而利用更丰富的 OOD 数据增强或因果推理手段来构建真正安全的自动驾驶系统。