本文提出了 VEGA-3D 框架,通过将预训练视频生成模型(如 Wan2.1)转变为“潜空间世界模拟器”,提取其隐含的 3D 几何与物理先验。该方法在不依赖显式 3D 监督的情况下,显著提升了多模态大模型(MLLM)在 3D 场景理解和空间推理中的性能,达到了 SOTA 水平。

TL;DR

如果一个 AI 模型能生成物理规律正确的视频(比如物体遮挡、相机移动时的视差),那么它一定在潜意识里“懂” 3D。VEGA-3D 正是基于这一洞察,将视频生成模型(Video Generation Models)作为潜空间世界模拟器,提取其中的隐含几何特征注入到 MLLM 中。这种“降维打击”的方式让模型在完全没有见过 3D 点云的情况下,空间推理能力大幅超越了许多专门针对 3D 设计的 SOTA 模型。

背景定位:从“画得好”到“看懂世界”

目前的视频生成模型(如 Sora, Wan2.1)在视觉真实感上已经登峰造极。工业界一直有一个假设:生成模型是世界模拟器。但如何量化这种“模拟”能力并将其转化为可用的机器视觉动力?VEGA-3D 成功填补了这一空白。它将该工作定位于“生成式先验驱动的空间理解”,是一种全新的、无需 3D 标注的高效范式。

痛点深挖:MLLM 的“视觉空间缺失”

尽管 GPT-4o 等模型语义能力极强,但在判断“桌子在我的左后方还是右前方”时经常翻车。

- 数据稀缺:高质量的 3D 扫描数据(ScanNet 等)规模远小于互联网视频。

- 归纳偏置:传统的 CLIP 等语义编码器(SigLIP)倾向于识别“有什么”,而非“在哪里”,导致模型对几何结构不敏感。

方法论详解:如何唤醒生成模型的 3D “记忆”?

1. 多视图一致性:衡量 3D 能力的金标准

作者提出了一个关键指标:Multi-view Correspondence Score。通过对比同一物体在不同视角下特征的相似度,作者发现基于 DiT (Diffusion Transformer) 架构的生成模型(如 Wan2.1)表现远优于传统的 UNet 架构。这种全局注意力机制天然地保留了长程的几何依赖。

2. 世界模拟器:提取中间态特征

研究发现,直接拿生成模型的最终像素输出没用。真正的“真理”藏在去噪过程的中间阶段(Mid-denoising)。

- 噪声注入:给输入图像加上适量噪声,强制模型通过“脑补”去修复图像,从而激活其内在的物理规律。

- 层级选择:中间层的特征在空间精度与语义抽象之间达到了完美平衡。

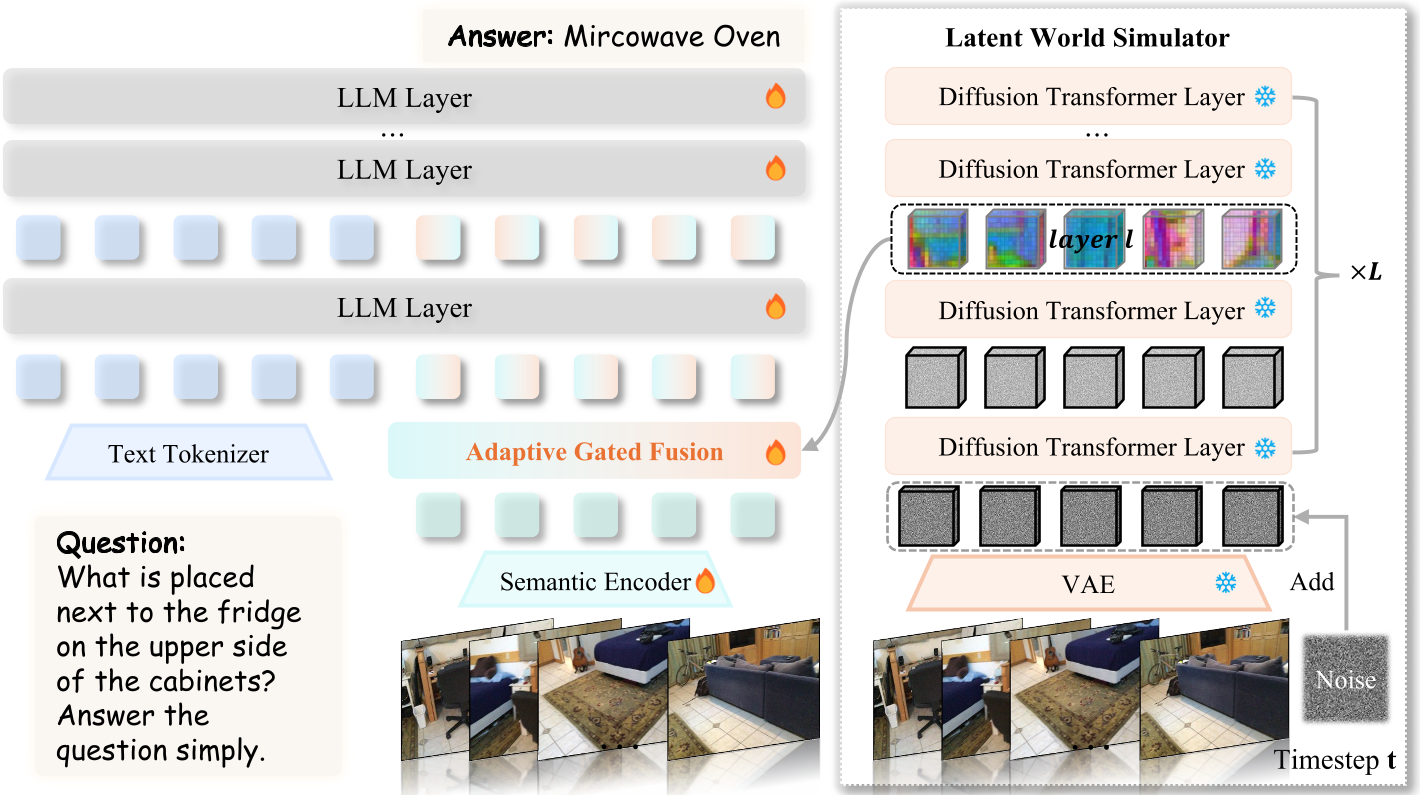

上图展示了 VEGA-3D 的双分支架构:语义分支负责“认出物体”,生成分支负责“定位空间”。

上图展示了 VEGA-3D 的双分支架构:语义分支负责“认出物体”,生成分支负责“定位空间”。

3. 自适应门控融合 (Adaptive Gated Fusion)

生成特征和语义特征属于不同的流形。VEGA-3D 引入了一个 Token 级别的开关(Gate)。当任务需要识别细节时,权重流向语义分支;当涉及距离、方向判断时,权力交给生成先验。

实验与结果:全方位碾压

VEGA-3D 在三类任务中表现惊人:

- 3D 场景理解:在 ScanRefer(视觉定位)和 ScanQA(空间问答)上稳定提升。

- 空间推理:在 VSI-Bench 上,即便是对比 72B 规模的巨型模型,VEGA-3D 也能以更小的参数量取胜。

- 具身智能:在 LIBERO 机器人操纵任务中,注入生成先验后,机器人在处理复杂物体交互时的成功率显著提高。

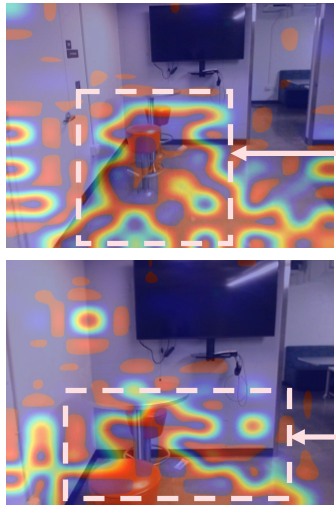

注意看热力图对比:引入 VEGA-3D 后(右侧),模型的注意力从发散态变得极其精准地聚焦在物体的核心几何锚点上。

注意看热力图对比:引入 VEGA-3D 后(右侧),模型的注意力从发散态变得极其精准地聚焦在物体的核心几何锚点上。

深度洞察:来自物理世界的“免费午餐”

VEGA-3D 的成功揭示了一个深刻的趋势:Scaling Law 正在从语言延伸到物理世界理解。

- 不再纠结 3D 标注:既然视频随处可见,而高质量视频生成模型又已经学习了物体的运动模式和几何结构,我们完全可以弃繁就简。

- 局限性:目前唯一的代价是推理成本。运行一个完整的视频扩散模型作为 Back-end 相当吃算力。

总结 (Takeaway)

VEGA-3D 证明了:生成的终点即是理解的起点。对于开发者和产品经理而言,这意味着如果你需要提升 AI 的空间感知能力,与其花费巨资寻找点云数据标注团队,不如考虑如何巧妙地利用已有的生成式基础模型。

未来,这种“潜空间理解”可能会被进一步蒸馏到轻量级模型中,成为具身智能设备的标配感知引擎。