本文提出了 Know3D,一种利用多模态大语言模型(MLLM)知识引导 3D 生成的创新框架。通过将 Qwen-Image-Edit 的中间层隐藏状态(Hidden States)注入 3D 生成模型,Know3D 实现了对物体背面(back-view)等不可见区域的语义可控生成。

TL;DR

传统的单张图片转 3D(Image-to-3D)任务常像开盲盒:你永远不知道模型会给物体的背面“脑补”出什么奇怪的形状。Know3D 通过引入 Vision-Language Models (VLMs) 的深层知识,首次实现了对 3D 资产不可见区域的语言可控生成。它不只是生硬地参考图像,而是理解了“什么是背面”。

背景定位:从“盲目脑补”到“语义理解”

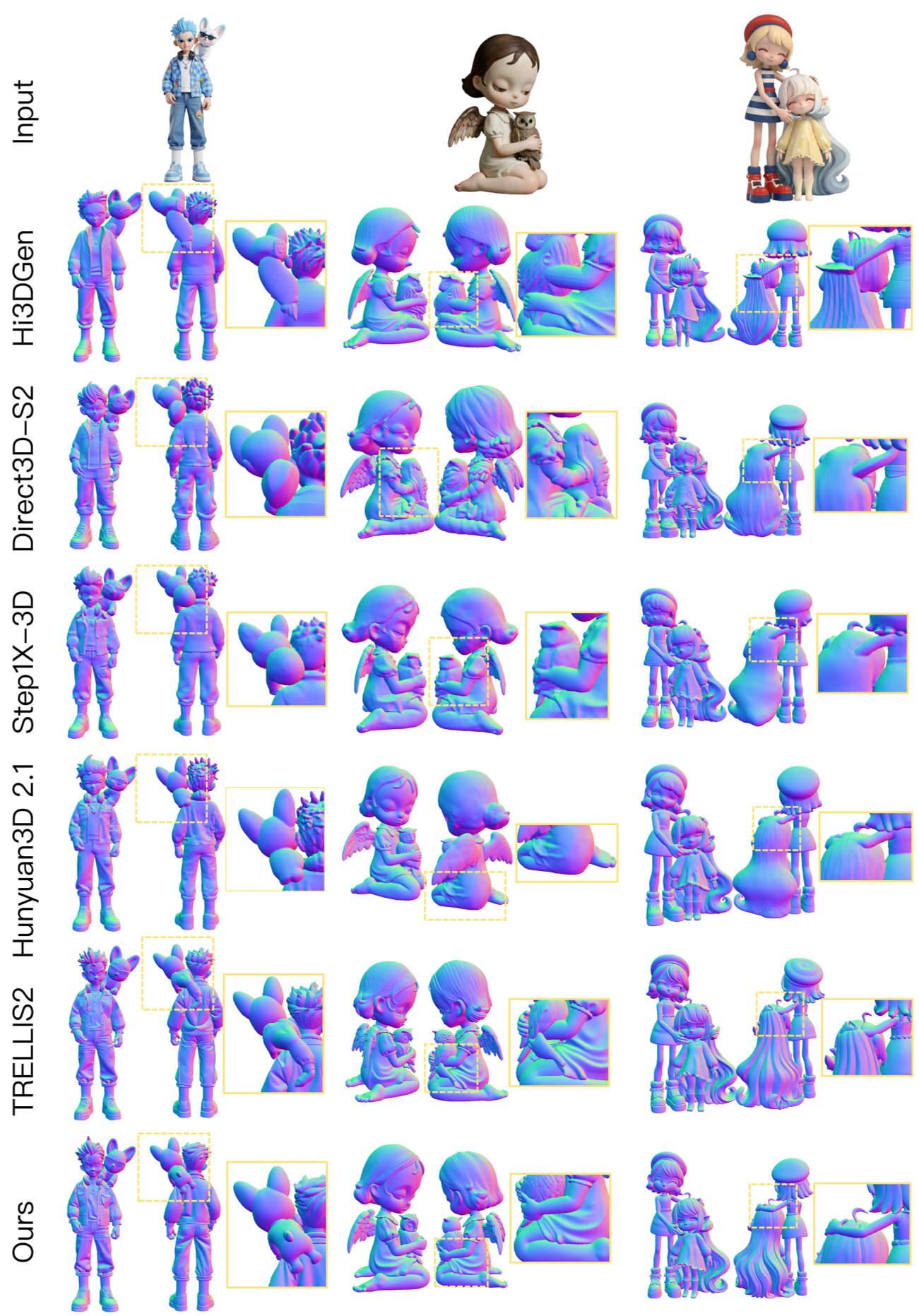

当前的 SOTA 方法(如 TRELLIS, Direct3D-S2)在几何精度上已非常惊人,但在处理单视图之外的区域时,由于缺乏 3D 数据支撑的全局常识,表现得非常随机。

作者认为,互联网规模的 2D 图像-文本数据中已经包含了丰富的物理常识和空间逻辑。Know3D 的核心贡献在于,它将多模态扩散模型(Qwen-Image-Edit)作为桥梁,把抽象的语义指令转化为具体的 3D 结构约束。

核心动机:为什么直接用 VLM 不行?

作者指出两种失败的直觉:

- 自回归生成 3D 序列(如 MeshGPT):这种方式通常分辨率较低,且破坏了 VLM 原有的强大语义先验。

- 直接输入 VLM 特征:这些特征过于抽象,缺乏 3D 生成所需的空间定位感。

Know3D 的 Insight:扩散模型(Diffusion Transformer, DiT)在去噪过程中,其中间层的隐藏状态(Hidden States)天然携带了空间结构和语义的双重信息。

方法论详解:知识注入的“外科手术”

Know3D 的架构分为两个关键阶段:

1. 语义感知的正反向生成训练

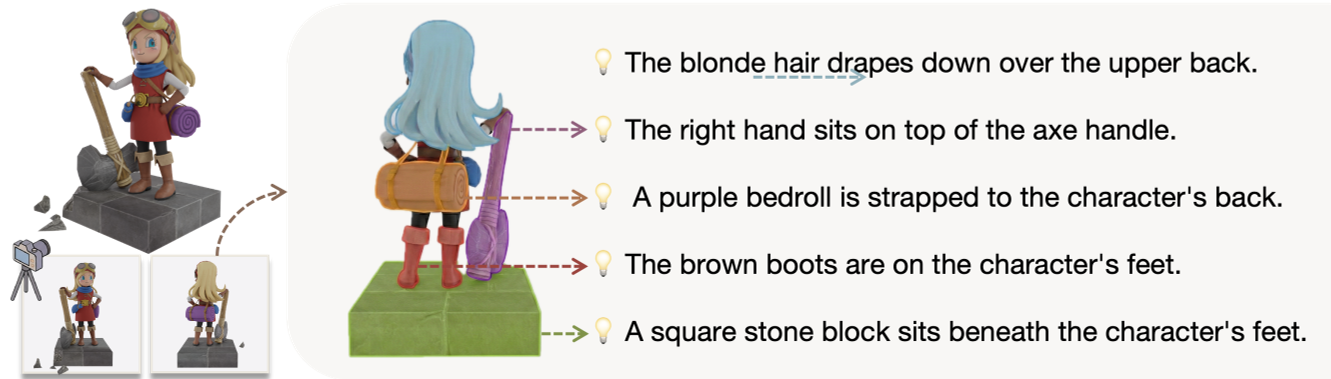

为了让模型听懂“生成背面”这个指令,作者微调了 Qwen2.5-VL,使其能够根据正面图和文字描述(如“带有拉链的背包背面”)生成合理的投影效果。

2. 隐藏状态注入 (Hidden-State Injection)

这是 Know3D 的精髓。它没有直接使用生成的图像(因为图像可能存在像素级瑕疵),而是提取了 MMDiT 在 $t=0.25$ 时间步的中间层特征 $H_{DiT}$。

在 3D 生成模型(基于 TRELLIS2)中,作者设计了一个平行交叉注意力分支:

- 保留原分支:确保不破坏预训练的 3D 生成分布(Prior)。

- 新增控制分支:利用 $H_{DiT}$ 引导不可见部分的几何拓扑。

实验与结果:语义控制的威力

在 HY3D-Bench 的对比中,Know3D 在语义一致性上全面超越了基线模型。

关键发现:

- 消融实验显示,提取 $t=0.25$ 时刻的特征效果最好。作者解释称,此时模型已确定了全局布局,但还没被过多的局部像素噪声干扰。

- 可控性展示:如果你给模型一张椅子正面图,你可以通过文字命令让它生成“圆柱形腿的背面”或“十字架支撑的背面”,这在以前的 stochastic 方法中是无法想象的。

深度洞察:3D 生成的未来在 2D 知识中?

Know3D 实际上是在用“知识”弥补“数据”的不足。3D 扫描数据永远无法达到 2D 互联网数据的量级,因此这种通过扩散模型隐藏状态来“蒸馏”语义常识的方法,可能会成为未来 3D 内容创作(AIGC 3D)的主流范式。

结论与局限: 虽然 Know3D 解决了可控性问题,但其上限取决于底层 MLLM 的理解能力。如果 Qwen 无法理解复杂的空间指令,3D 生成依然会产生偏差。如何更精细地对齐 2D 特征与 3D 空间体积,仍是值得探索的方向。