本文推出了 MME-CoF-Pro,这是首个专门评估视频生成模型“推理连贯性”(Reasoning Coherence)的深度基准测试。该基准包含 16 个类别的 303 个样本,涵盖从基础感知到复杂物理规律的推理任务,并引入了基于过程的 Reasoning Score (RS) 评估体系。

TL;DR

尽管当前的视频生成模型(如 Sora, Veo)能生成极具震撼力的视觉效果,但它们是否真正理解所生成的物理现象?此篇来自东北大学、香港中文大学等机构的论文推出了 MME-CoF-Pro 基准,通过 16 个推理维度和全新的 Reasoning Score (RS) 指标,揭示了视频模型在推理连贯性上的短板:画面质量与逻辑推理几乎是“各玩各的”。

核心速览:视觉巅峰下的“逻辑黑盒”

在视频生成领域,我们见证了从模糊像素到电影级画质的跨越。然而,当被要求模拟“一个苹果掉进罐子并弹出来”这种涉及多步因果的操作时,模型常常出现逻辑断层。作者将这种跨帧遵循因果动态的能力定义为 Reasoning Coherence(推理连贯性)。

图 1:MME-CoF-Pro 通过人类验证的步骤(Rubrics)对生成的每一阶段进行打分,而非仅看最后一眼。

图 1:MME-CoF-Pro 通过人类验证的步骤(Rubrics)对生成的每一阶段进行打分,而非仅看最后一眼。

痛点深挖:为什么 SOTA 榜单“骗”了我们?

以往的基准(如 VBench)侧重于颜色评分、运动流畅度。即便一些推理基准(如 V-ReasonBench)也多采用 Pass@k 机制,只看最后一帧。这种“结果导向”的评估无法识别模型是“误打误撞”还是“逻辑严密”。本文作者敏锐地发现:视频模型的推理能力与其生成质量是解耦的。 换句话说,画得再真实,逻辑也可能是一塌糊涂。

方法论详解:拆解因果的“节拍器”

MME-CoF-Pro 的核心创新在于两点:

- Reasoning Score (RS):通过 Gemini-2.5-Flash 作为评委,对照人类预设的 个关键推理步骤(如:物体接触 -> 发生形变 -> 轨迹改变),计算完成率。

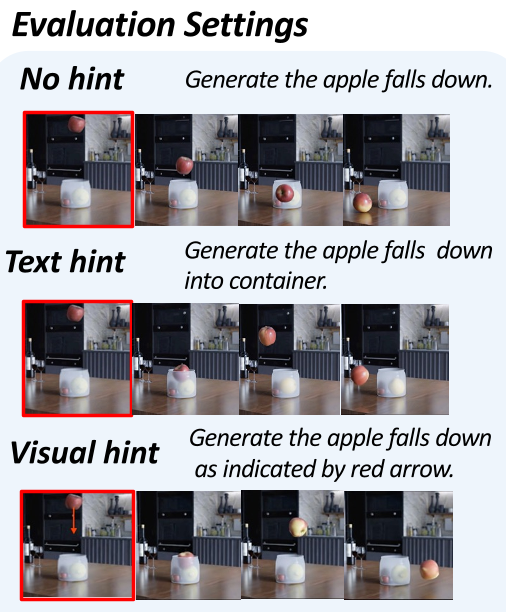

- 控因诱导实验:引入了三种设置,试图分析模型如何处理“提示”:

- No Hint:纯盲测,考验模型内化的常识。

- Text Hint:加入步骤描述。

- Visual Hint:在输入图上画框或箭头(Bounding Boxes/Arrows)。

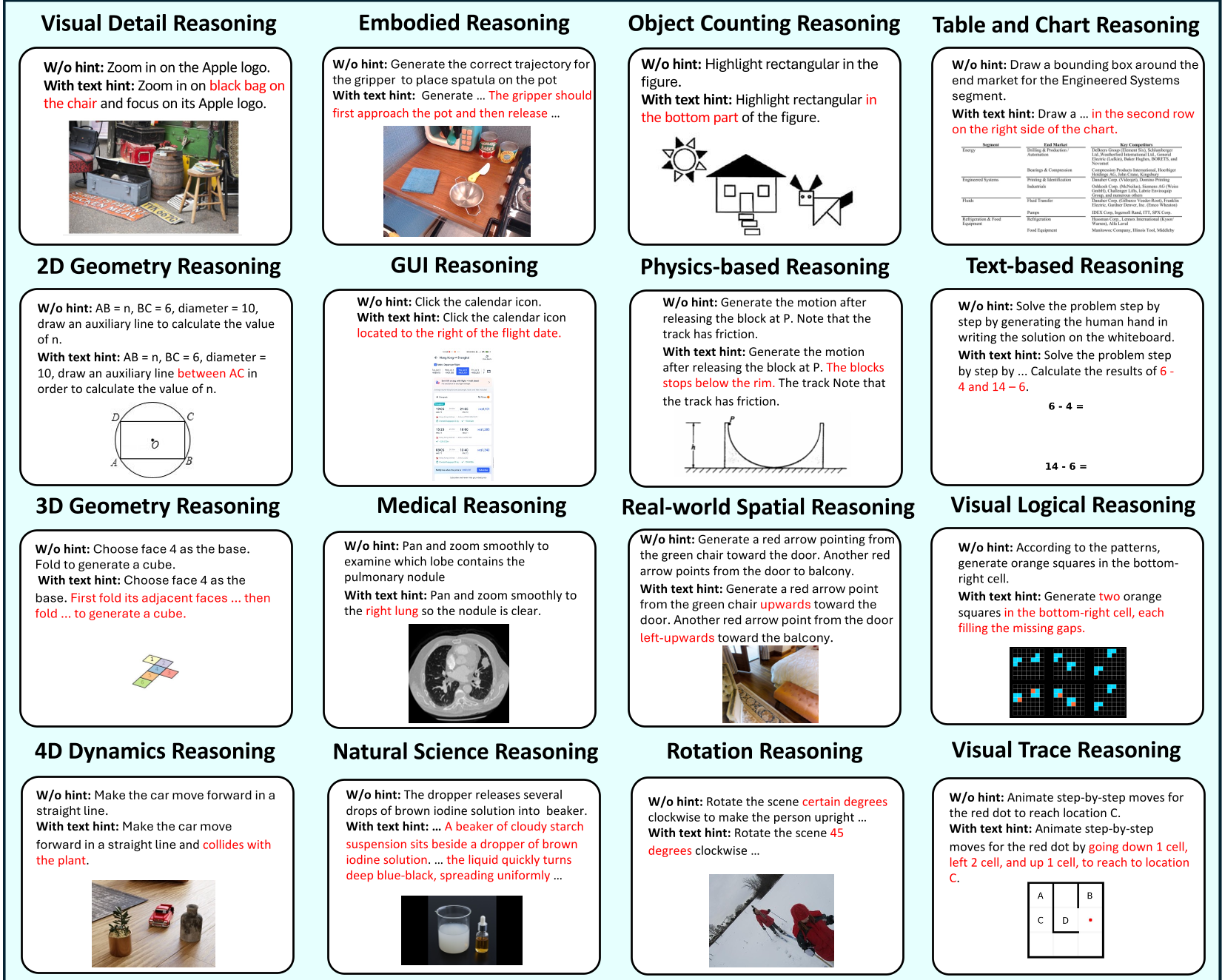

图 2:涵盖视觉逻辑、科学推理等 16 个子类,深度测试模型的认知边界。

图 2:涵盖视觉逻辑、科学推理等 16 个子类,深度测试模型的认知边界。

实验与结果:揭开“提示”的遮羞布

实验评估了包括 Veo3.1, Sora2, Kling-v2.1 在内的 7 款顶尖模型,结论极具冲击力:

- 高画质低智商:Kling 在画面质量(Avg)上表现不俗,但推理分数(RS)仅为 13.8%,说明它倾向于优化视觉纹理而非逻辑。

- 文本提示是“双刃剑”:加入 Text Hint 后,模型的分数显著提升(Veo +4.5%, Sora +7.6%),但代价是 Consistency Score (CS) 的崩塌。模型为了强行完成指令,常会凭空“变”出多出的物体(幻觉),导致画面闪烁。

- 视觉提示的陷阱:在需要精细感知的任务中,Visual Hint(如红框)反而会干扰模型,模型有时会把输入的红框直接画进输出视频里。

表 1:各模型在 RS 与 GQ(生成质量)上的表现。注意看两者的不对称性。

表 1:各模型在 RS 与 GQ(生成质量)上的表现。注意看两者的不对称性。

深度洞察:未来的路在哪里?

MME-CoF-Pro 的研究揭示了一个严酷的事实:目前的视频大模型更多是在“临摹”轨迹分布,而非“模拟”物理世界。

- 由“跟从”转向“理解”:当给予详细步骤时,模型更倾向于字面意思的堆砌,而不是理解背后的因果联动。

- 抗幻觉机制:视频生成模型迫切需要类似于 LLM 的指令微调(Instruction Tuning),以确保在复杂逻辑链下不丢失时空稳定性。

总结 (Takeaway):这篇工作提醒我们,评估视频模型不能只做“颜控”。MME-CoF-Pro 为我们提供了一个透视镜,让我们看到在华丽特效之下,AI 离真正的“世界模型”还有多远。