本文提出了 Neural Computer (NC) 这一新范式,旨在将计算、内存和 I/O 统一在学习到的运行时隐藏状态(Latent Runtime State)中。作者通过在 CLI 和 GUI 界面上构建基于视频生成的原型系统,展示了模型如何直接从视频数据中学习操作系统级别的交互逻辑。

TL;DR

本文提出了一种名为 Neural Computer (NC) 的新兴机器形态。它不再是一个运行在 Linux 或 Windows 之上的 AI 智能体,而是试图将计算、存储和输入输出 (I/O) 全部集成在一个训练好的神经网络权重中。通过基于视频生成的原型,研究者证明了模型能够直接通过像素和动作轨迹学习 CLI(命令行)和 GUI(图形界面)的运行逻辑。

背景定位:这是迈向 Completely Neural Computer (CNC) 的开山之作。它挑战了冯·诺依曼架构中计算与存储分离的传统,提出了一种全新的“神经潜层栈(Neural Latent Stack)”。

痛点深挖:为什么我们需要“神经计算机”?

在当前的学术界,我们通常在三个坐标轴上讨论 AI:

- Conventional Computers:可靠执行精确程序,但遇到模糊输入或噪声时极其脆弱。

- AI Agents:作为现有软件栈的媒介,通过外接工具执行任务,但“大脑”与“肢体”脱节。

- World Models:预测物理或环境演化,但通常仅作为模拟器,不具备系统级的可编程性。

作者发现,现有的堆栈(Stack)在处理高维感知(如图像、自然语言)和模糊逻辑时效率低下。Neural Computer 的动机就是消除这种隔阂,让模型直接成为运行时的计算机。

核心机制:潜状态下的更新与渲染循环

Neural Computer 的核心数学表达可以简化为一个 Update-and-render loop:

$$h_t = F_{ heta}(h_{t-1}, x_t, u_t), \quad x_{t + 1} \sim G_{ heta}(h_t)$$

其中 $h_t$ 是持久化的运行时内存,$F_{ heta}$ 负责状态更新计算,而 $G_{ heta}$ 则将抽象的潜状态解码为下一帧像素。

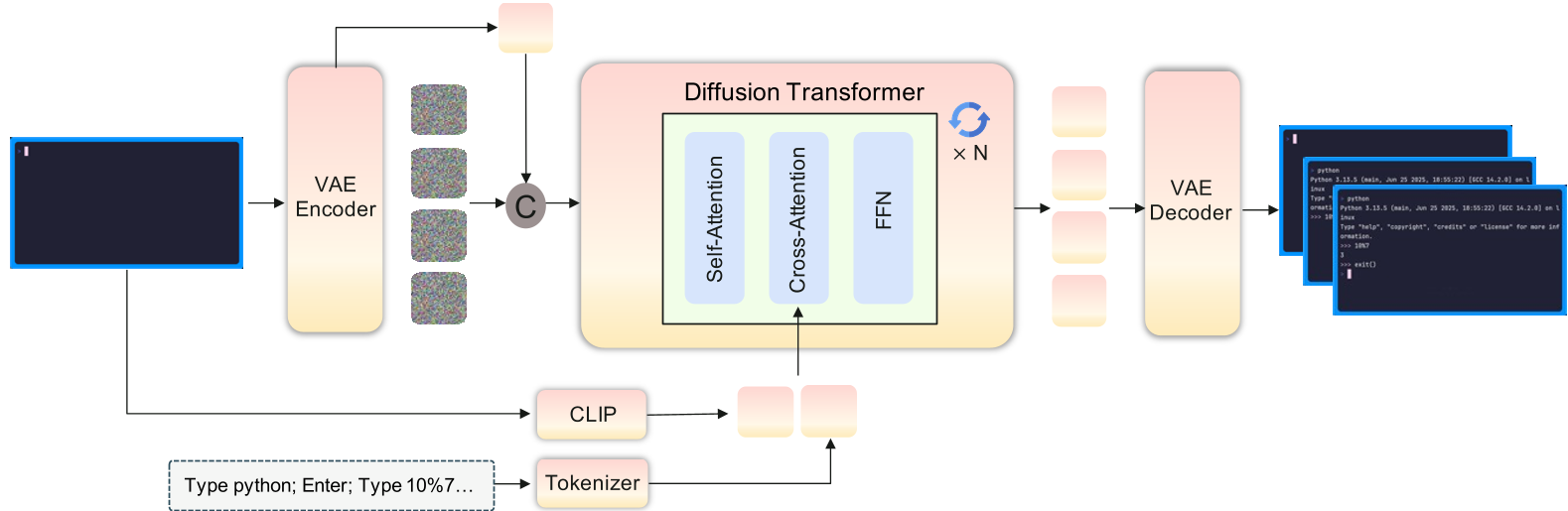

1. NCCLIGen:字符级的精确模拟

针对命令行界面,研究者构建了 NCCLIGen。它能捕捉复杂的 CLI 物理特性,如窗口缩放、语法高亮和快速滚动。

- Insight:研究发现,描述性的 Prompt(如详细的字面描述)能显著提升渲染精度,PSNR 从语义描述的 21.90 提升到详细描述的 26.89。

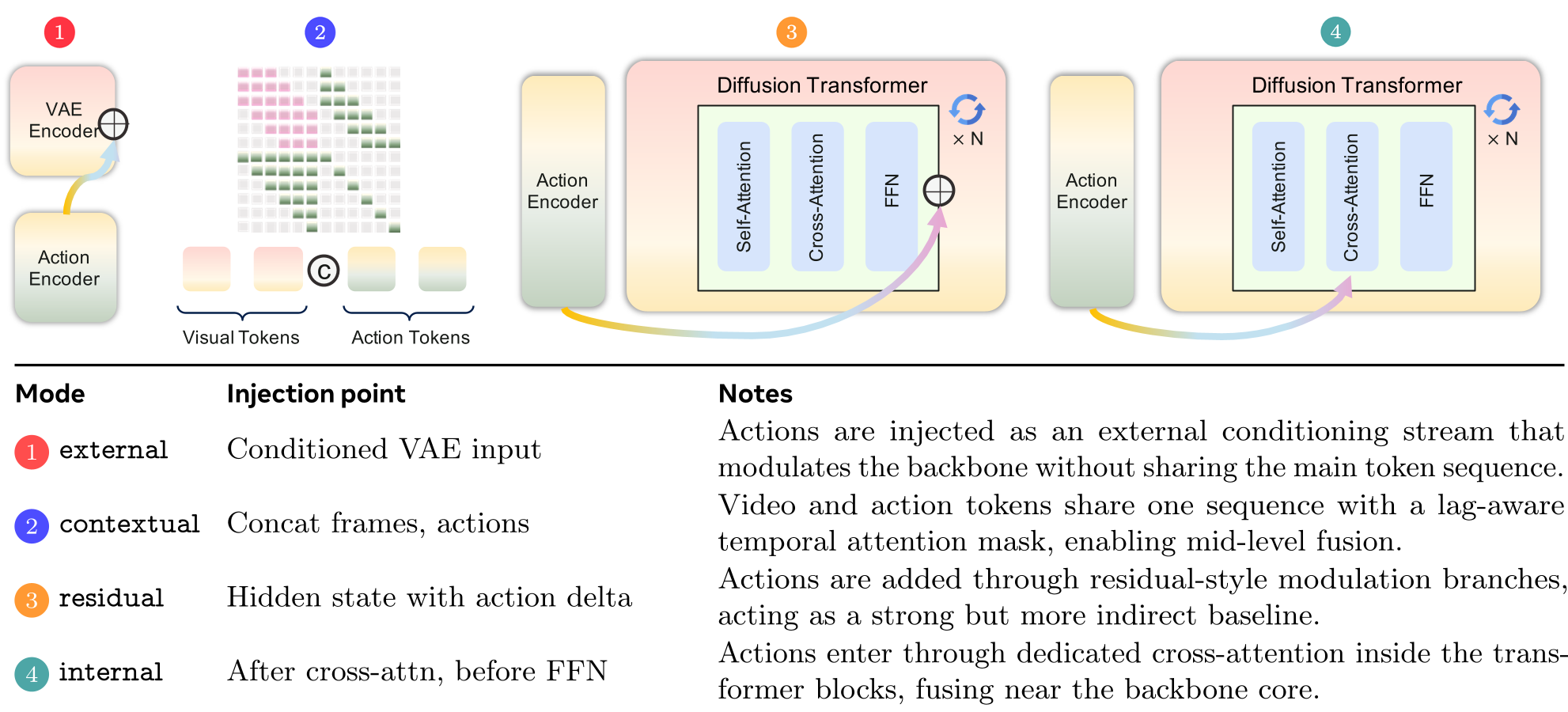

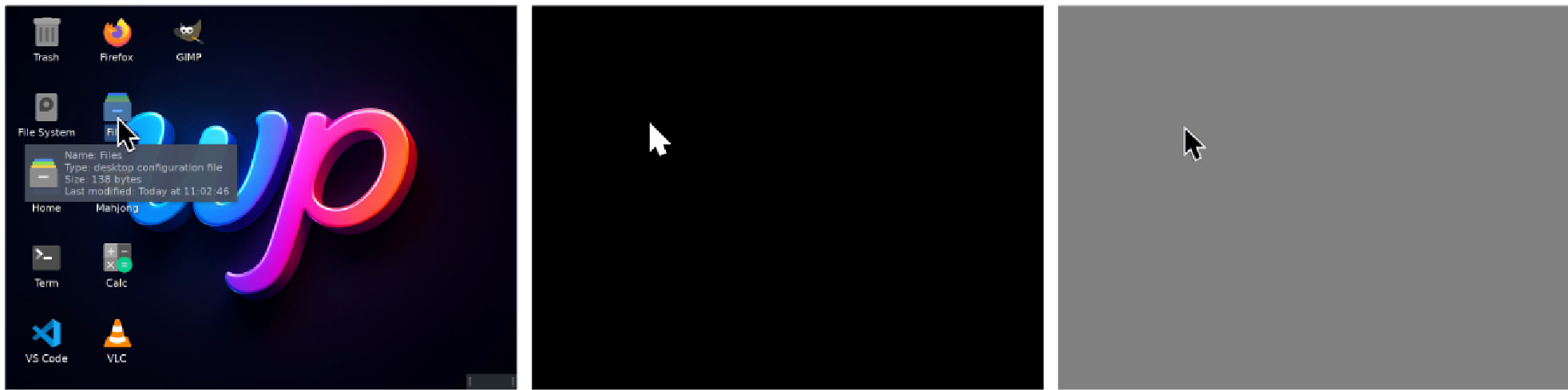

2. NCGUIWorld:动作感知的图形世界

要在视频中准确控制光标(Cursor),论文对比了四种动作注入方案(External, Contextual, Residual, Internal)。实验证明,Internal Conditioning(即在 Transformer 块内部嵌入 Cross-attention)能够提供最连贯的点击反馈。

实验战绩:精度与控制的权衡

实验中最惊人的发现是:纯坐标监督不足以支持精确交互。 仅提供 (x, y) 坐标时,光标精度仅为 8.7%-13.5%,模型经常出现飘逸。作者通过引入 SVG Mask 辅助监督(让模型显式学习光标作为一个视觉对象),将精度瞬间拉升至 98.7%。

而在符号推理方面,虽然模型在基础算术测试(CLI Arithmetic Probe)中表现一般(仅 4% 成功率),但通过 Reprompting(重新提示),成功率飙升至 83%。这表明,虽然目前的视频基底(Backbone)原生计算能力尚缺,但其对外部指令的可控渲染能力已经极强。

深度洞察:通往 Completely Neural Computer (CNC) 的路线图

作者认为,一个发育完全的 CNC 必须满足三个 Lenz(透镜)标准:

- Routine Reuse(例程重用):一旦学会一个操作,模型应能够持久保留并像调用函数一样重用它。

- Execution Consistency(执行一致性):相同的输入应产生可预测、稳定的行为,而不是随机抖动。

- Update Governance(更新治理):明确区分“运行”与“重编程”。普通输入不应改变模型行为,只有显式的“指令”才应触发系统层面的在线学习。

总结与局限

Takeaway:Neural Computer 开启了“机器原生(Machine-native)”架构的讨论。通过将整个 OS 栈坍缩进一个神经网络,我们可能获得处理非结构化数据和复杂 UI 的究极效率。

局限性:尽管视觉渲染惊人,但其符号逻辑、长程逻辑一致性和真正的图灵完备性仍处于早期阶段。目前的视频模型更像是一个“极其聪明的屏幕模拟器”,而非一个“绝对严谨的计算核心”。