本文提出了一种将 Transformer 架构映射到哺乳动物大脑皮层柱(Cortical Column)的理论框架,认为皮层的分层微电路(Laminar Microcircuits)在功能上实现了类似于 Transformer 的上下文相关、乘法门控交互。该研究将皮层 4 层映射为输入嵌入,2/3 层和 5 层映射为查询(Queries)与键(Keys),并成功解释了大脑如何通过生物物理机制(如树突非线性)实现复杂的注意力路由。

TL;DR

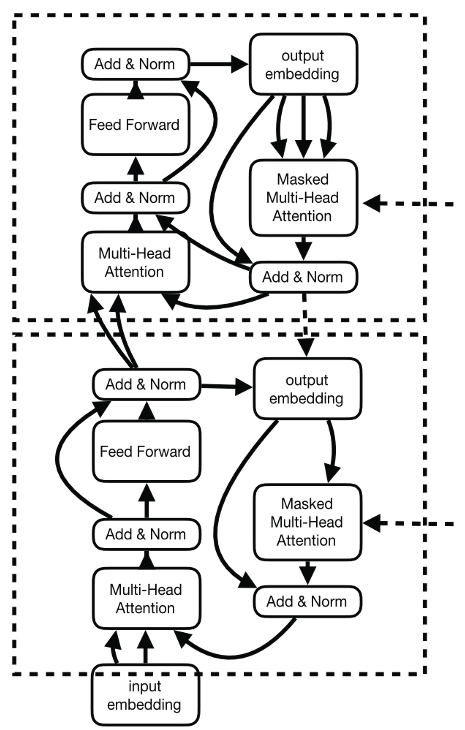

长期以来,AI 界认为 Transformer 架构是以工程为导向的非生物设计。然而,本篇论文提出了颠覆性的视角:大脑皮层柱(Cortical Column)本质上就是一个功能完备的生物 Transformer 模块。通过将皮层的 6 层结构与查询(Query)、键(Key)、值(Value)进行精准映射,作者展示了进化如何通过树突非线性和局部抑制电路,精妙地实现了现代 AI 最核心的自注意力(Self-Attention)机制。

1. 痛点:为什么传统的 CNN/RNN 模拟大脑不再够用?

长期以来,神经科学用“卷积”来类比视觉层级,用“循环(Recurrence)”来解释动态记忆。但这些模型难以解释皮层最显著的特征:极其精细的分层结构(Lamination)。

- 低效的路由:传统模型中,信息流相对固定。

- 忽略了上下文:大脑如何根据全局目标动态地选择性处理局部信息?

- 架构脱节:SOTA 的语言模型已经是 Transformer,而我们的脑模型还停留在 80 年代的连接主义。

作者认为,皮层柱不仅是信息的传递者,更是基于上下文的路由器。

2. 核心直觉:将皮层柱视为 Transformer Block

作者打破了“一个脑区对应一个网络层”的陈旧观念,提出:一个皮层柱 = 一个 Transformer 模块。

Q/K/V 的生物学化身:

- Values (V):来自丘脑或下游皮层的 L4 输入。它提供了“处理内容”。

- Queries (Q) & Keys (K):L2/3 和 L5 的水平连接(Horizontal)与反馈连接。它们决定了“谁应该关注谁”。

- 注意力权重 (Attention Weights):皮层 5 层锥体神经元的顶端树突(Apical Dendrites)。当顶端输入(上下文/Q)与基底输入(内容/K)同时活跃时,会触发特殊的钙离子爆发(BAC Firing),这正是乘法门控(Multiplicative Gating)的完美生物实现。

- Softmax:皮层内的局部侧向抑制(Lateral Inhibition)实现了“赢家通吃”的归一化效果。

3. 深度解析:分层电路如何协作?

论文不仅给了定性描述,还详细拆解了每一层的功能(见下表):

| 组件 | 皮层对应物 | 功能描述 | | :--- | :--- | :--- | | Token | 皮层柱 (Column) | 地图上的基本处理单元 | | Multi-Head | 神经元亚群 | 共享输入但采样不同上下文的并行通道 | | FFN 子层 | 跨层重新编码 | 将处理后的表示映射回特征空间 | | LayerNorm | E-I 平衡 | 维持表征空间的几何稳定性 |

频率解耦:

作者进一步提出,大脑通过不同的振荡频率来实现 Transformer 的编码(Encoder)与解码(Decoder):

- Gamma 带 (30-80Hz):主要位于浅层 (L2/3),负责前馈编码。

- Alpha/Beta 带 (8-30Hz):主要位于深层 (L5),负责反馈预测与解码。

4. 实验预测:如何证伪这个模型?

作为资深主编,我认为该工作最深刻之处在于其提出了可证伪的预测:

- 响应分化:在一个皮层柱内,如果只给简单的几何刺激,神经元表现相似;但在复杂任务中,由于“注意力头”的不同,神经元应表现出截然不同的上下文依赖性。

- 分层干预:干扰 L1 层的顶部反馈(Q)应该只改变神经元的增益和选择性,而不改变其基本的感受野内容(V)。

5. 局限性与展望

尽管该模型极具启发性,但仍面临挑战。例如,大脑中的“Token”是连续且重叠的地图,而非 Transformer 中离散的符号;此外,大脑的循环是持续不断的,而非 Transformer 的单向解码。

结论:这篇论文标志着神经科学与 AI 正在从“简单的生物灵感”转向“深层的架构汇合”。大脑皮层分层结构可能正是自然界演化出的、最节能且高效的“动态路由服务器”。

总结 (Takeaway)

皮层不仅在“计算”,更在“路由”。如果你在寻找下一代 AI 的突破口,请关注如何利用类似皮层柱的分层微电路来构建具备动态上下文处理能力的硬件架构。