本文推出了 NymeriaPlus,这是对 2024 年发布的 Nymeria 大规模第一视角(Egocentric)数据集的重大升级。该版本通过集成更精准的参数化人体运动(MHR/SMPL)、密集的室内场景 3D/2D 边界框标注、实例级 3D 物体重建以及新增的腕带视频和音频模态,构建了一个支持具身智能(Embodied AI)跨模态学习的高质量基准。

TL;DR

Meta Reality Labs 发布了 NymeriaPlus,这是目前全球最强的野外(In-the-wild)第一视角多模态数据集。通过对原版 Nymeria 的深度“大修”,它不仅修补了动捕数据中的“滑步”与“穿模”顽疾,还塞进了极其密集的 3D 边界框和物体三维重建模型。这标志着 AI 对人类行为的理解从“看马赛克点云”跨越到了“理解真实的物理交互空间”。

1. 痛点:为什么“逼真”的运动数据这么难?

在具身智能领域,我们面临一个尴尬的悖论:

- 实验室内(Controlled):动捕精度高,但场景假、动作呆板。

- 野外(In-the-wild):动作真实,但传感器漂移严重。基于惯性动捕(XSens)的数据经常出现“脚在地下走、手在肚子里插”的尴尬情况。

原版 Nymeria 虽有 300 小时的数据量,但其提供的运动轨迹主要基于单纯的坐标对齐,缺乏对惯性累积误差的约束。此外,对于 AI 来说,仅仅知道人在动是不够的,如果不知道人旁边的桌子有多高、沙发有多宽,就无法学习“坐下”或“取物”的物理直觉。

2. 核心突破:多源约束下的运动优化

NymeriaPlus 最核心的技术贡献在于其联合优化框架。它不再只听信 XSens 动捕服的数据,而是引入了 Project Aria 眼镜和 miniAria 腕带的 6-DoF 视觉定位信息作为“指挥官”。

运动模型升级:从封闭到通用

作者弃用了闭源模型,全面支持 MHR (Momentum Human Rig) 和 SMPL。

- MHR 的优势:它将身体表面与底层骨骼解耦。这意味着通过回归分析,可以针对不同身高的受试者精确调整骨骼长度,从根本上减少了因骨骼比例不匹配导致的运动畸变。

联合优化目标函数

优化过程不仅考虑了关节角度(驱动力),还加入了一系列强物理约束:

- 轨迹约束():确保虚拟人的头和手必须贴合眼镜和腕带的真实运动轨迹。

- 脚部防滑():当检测到脚与地面接触或速度接近零时,强制锁定位置,有效解决了“太空步”问题。

图中黄色(MHR)和绿色(SMPL)展示了优化后的效果,相比原版蓝色轨迹,手部定位精度大幅提升。

图中黄色(MHR)和绿色(SMPL)展示了优化后的效果,相比原版蓝色轨迹,手部定位精度大幅提升。

3. 语义森林:万物皆可 Bounding Box

NymeriaPlus 不满足于只给出一堆杂乱的点云,它在 47 个室内场景中建立了**基座图(Basemap)**机制:

- 标注转移:先在静止的场景扫描中进行精细标注,再利用空间对齐技术一键转移到数百个运动序列中。

- 闭集与开集并存:提供 19 类常见家具(Bed, Chair, Table等)的闭集标注,同时针对长尾物体(Cup, Bag等)提供了 Anything 类别的开集标注,总数超过 2 万个实例。

- 高保真重建:不仅仅是方盒子,作者利用 ShapeR 模型,为每一个物体生成了 4 个候选 3D 网格模型,并由人工筛选出质量最高的一个。

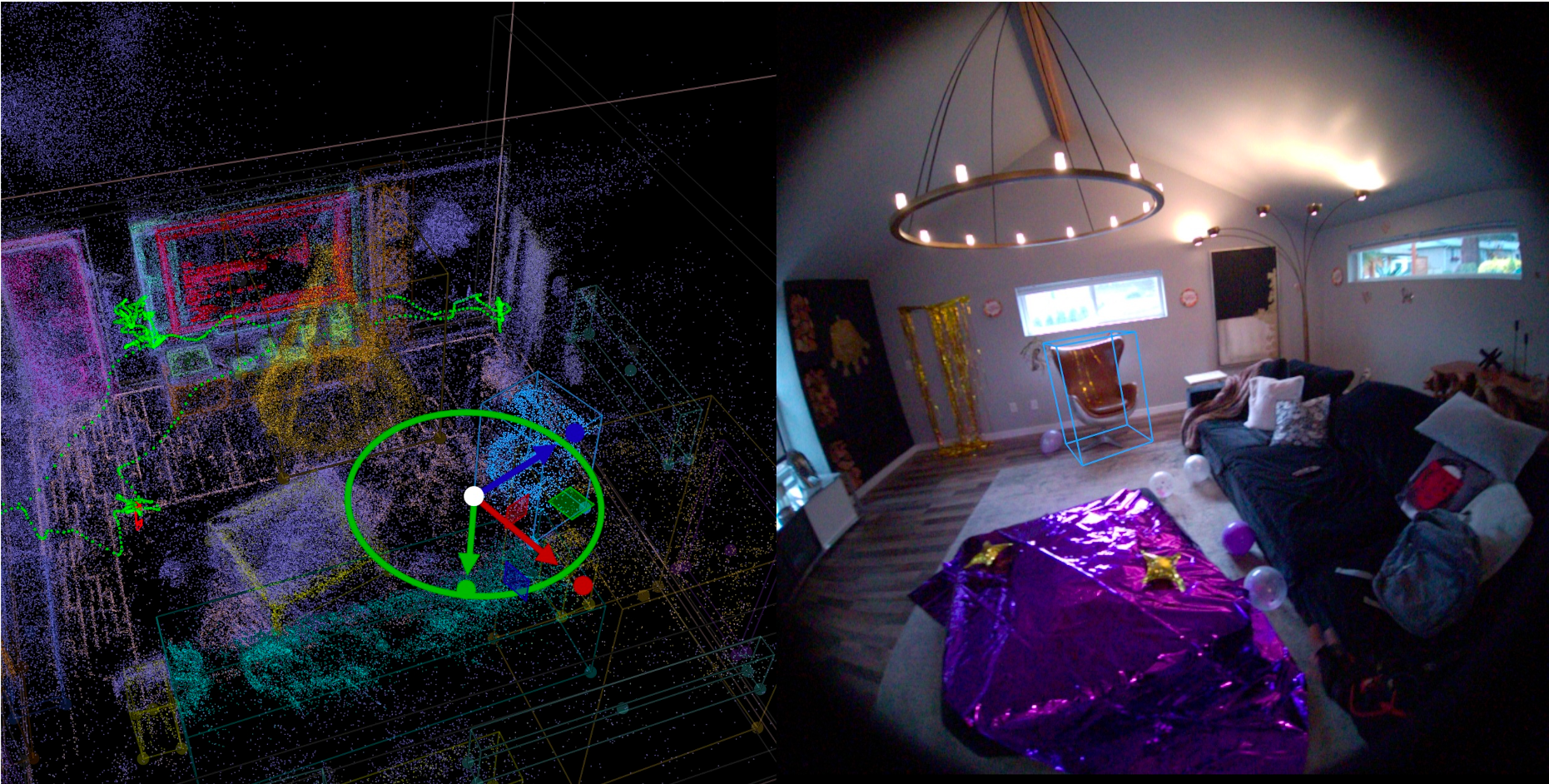

作者开发的 Boxy 工具允许在 3D 点云与 2D 图像投影之间进行无缝校验,确保边界框的 9-DoF 参数万无一失。

作者开发的 Boxy 工具允许在 3D 点云与 2D 图像投影之间进行无缝校验,确保边界框的 9-DoF 参数万无一失。

4. 实验战绩:全方位的精度超越

实验结果验证了这种“强约束优化”的威力:

- 手部追踪:误差从 14.32cm 缩减到 5.07cm。

- 自穿透(穿模):错误得分从 18.67 降至 2.44,动作看起来更加“像人”。

- 滑步检测:在触地帧中,检测到滑步的比例从 35% 降至 9.81%。

这些带有语义和几何信息的实例级重建(彩色部分),让 AI 能够真正理解人类是如何在复杂的家居环境中穿行的。

这些带有语义和几何信息的实例级重建(彩色部分),让 AI 能够真正理解人类是如何在复杂的家居环境中穿行的。

5. 深度洞察与总结

NymeriaPlus 的发布意味着什么? 以前的第一视角研究更像是“动作捕捉演示”,而 NymeriaPlus 真正把“人”和“环境”锁死在了一个物理逻辑闭环里。

- 价值点:对于开发 AR 眼镜伴侣(能够提醒你钥匙落在那张红桌子上,或者指导你如何挪动沙发)的硬件厂商,这是目前最完美的训练场。

- 局限性:尽管运动得到了显著优化,但脚部滑动的消除依然依赖于启发式阈值,而非真正的地面反作用力物理模拟。同时,动态物体的实时 3D 追踪仍是缺失的一环。

- 启示:未来的 SOTA 模型将不再仅仅堆叠 Transformer 层数,而是需要一种能够同时处理 3D 几何、音频流和肢体动捕的**超模态(Hyper-modal)**架构。