本文提出了 IOMM,一种针对统一多模态模型(UMM)视觉生成的双阶段训练框架。该方法通过引入 Masked Image Modeling (MIM) 实现了仅使用无标签图像的大规模预训练,能够显著降低对高质量图文对数据的依赖,并在 GenEval 等基准测试上达到 SOTA 性能。

TL;DR

传统的统一多模态模型(UMMs)往往受困于对海量“图文对”数据的渴求。西湖大学等机构提出的 IOMM (Image-Only Training for UMM) 打破了这一僵局。它通过掩码图像建模(Masked Image Modeling)和残差查询适配器(Residual Query Adapter),实现了仅需图像即可进行高效视觉生成预训练。在 1.6B 的参数规模下,IOMM 仅用 1000 多 GPU 小时就刷写了 GenEval 的 SOTA 纪录,并展示了惊人的零样本(Zero-shot)图像编辑能力。

痛点深挖:昂贵的标签与低效的训练

目前 UMM 的视觉生成能力主要依赖于大规模的文本-图像对。然而,高质量的标注数据是稀缺且闭源的。此外,直接在理解模型(MLLM)上微调生成任务容易导致核心理解能力的“灾难性遗忘”。

作者发现,现有的 UMM 在处理复杂指令时经常出现细节缺失或对齐失败。究其原因,是生成模块没有建立起足够的视觉先验(Visual Prior)。

核心方法论:从稀疏到稠密的视觉重构

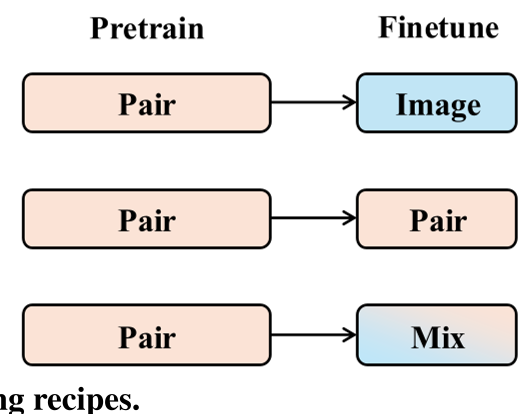

IOMM 提出了一个优雅的两阶段框架:

1. 图像自调节预训练 (Self-Conditioning)

作者提出一个深刻的洞见:图像本身就是其最完美的语义条件。通过冻结的 MLLM 提取图像的视觉特征,并将其作为生成器的输入,模型可以摆脱对文本标签的依赖。

2. 残差查询适配器 (Residual Query Adapter, RQA)

由于冻结 MLLM 的原始输出是为了“理解”设计的,直接用于“生成”会存在领域失配。RQA 模块(仅 29M 参数)通过 Cross-Attention 学习任务特定的变换,将理解表征转化为精细控制生成的指令,而无需触动庞大的 MLLM 主体。

3. 掩码图像建模 (Masked Image Modeling, MIM)

为了防止模型学成简单的“恒等映射”(即死记硬背输入图片),作者引入了 MIM。通过随机遮蔽一部分视觉 Token,强迫模型从残缺的信息中推断并重建出完整的图像。这种“由稀疏到稠密”的过程极大地增强了模型的组合生成能力。

图 1:IOMM 的训练范式对比及实验验证

图 1:IOMM 的训练范式对比及实验验证

实验战绩:以小博大的效率典范

IOMM 在多个主流榜单上展现了降维打击般的效率:

- 性能:IOMM-B (1.6B) 在 GenEval 整体得分上达到 0.89,超过了参数量更大的 BAGEL-7B (0.88) 和经过 3000 万专如图文对训练的 BLIP3-o-8B (0.84)。

- 效率:完成全阶段预训练仅需 1050 H800 GPU 小时(约 40 天单卡功耗),相比动辄数万小时的基线模型,成本极低。

- 通用性:该方法可以作为“插件”提升现有模型。例如,将 IOMM 的混合微调策略用于 Qwen-Image,使其 GenEval 分数显著提升。

表 1:IOMM 与各类 SOTA 统一多模态模型在 GenEval 和 WISE 上的量化对比

表 1:IOMM 与各类 SOTA 统一多模态模型在 GenEval 和 WISE 上的量化对比

深度洞察:惊喜的零样本编辑能力

除了文本生成图像,IOMM 在图像编辑上也表现出了意外的强大。通过仅在图像上进行的预训练,模型学会了深刻的视觉空间关系。在 ImgEdit-Bench 测试中,IOMM 在完全没有接触过编辑数据的情况下,其 Zero-shot 表现甚至优于许多专门在编辑数据集上微调过的模型(如 UltraEdit)。

总结与未来

IOMM 证明了:

- 生成先验不一定来自文本,掩码图像建模是获取高质量视觉先验的高效途径。

- “图像预训练 + 混合数据微调”是解决 UMM 数据饥渴的最佳实践。

- 轻量级的 RQA 适配器是连接理解模型与生成模型的有效桥梁。

局限性:虽然 IOMM 在 512px 分辨率下表现优异,但在更高分辨率(如 1024px)下的相对性能增益有所收敛,这可能与训练数据的多样性及计算资源分配有关。未来在超大规模数据集上的可扩展性(Scaling Law)值得进一步探索。