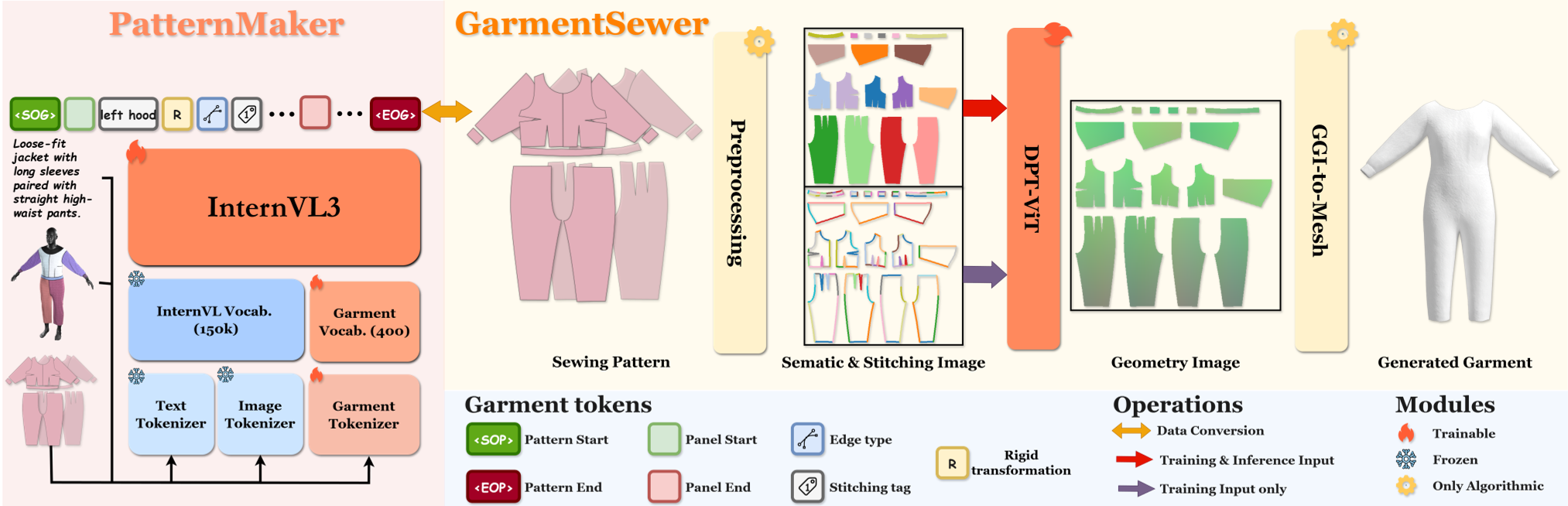

SwiftTailor 是一个高效的三维服装生成框架,通过引入全新的“服装几何图像 (Garment Geometry Image, GGI)”表征,实现了从 2D 缝制图样到 3D 网格的端到端生成。该方法结合了轻量化多模态大模型 PatternMaker 和深度预测转换器 GarmentSewer,在保持 SOTA 精度(Vertex L2 3.5)的同时,将推理速度提升了约 4 倍。

TL;DR

在数字时尚领域,从一张照片或一段文字生成“可制造、可模拟”的 3D 服装一直是个难题。传统方法卡在缓慢的物理仿真(Physical Simulation)环节。来自高通 AI 研究院(Qualcomm AI Research)的 SwiftTailor 提出了一个巧妙的思路:将 3D 给图问题转化为图像翻译问题。通过全新的 Garment Geometry Image (GGI) 表达方式,它能以比传统方法快 4 倍的速度生成高质量 3D 服装,且 3D 构造阶段耗时仅 20 毫秒。

核心速览

- 定位:SOTA 级的高效可解释 3D 服装生成框架。

- 关键词:Geometry Image, MLLM, Physics-free Construction, Digital Fashion.

- 成果:在推理速度、覆盖度(Coverage)以及几何精度(MMD)上全面超越之前的基线如 AIpparel 和 ChatGarment。

痛点深挖:为什么 3D 服装生成这么慢?

目前的 3D 生成模型(如各种 3D Diffusion)虽然能生成炫酷的形状,但对服装产业来说“不可用”。真实的衣服是由 2D 裁片(Patterns)缝合而成的。 现有流水线通常是:VLM 预测 2D 图样 -> 物理引擎模拟缝合力 -> 碰撞处理 -> 产生 3D 网格。 这种做法有两个致命伤:

- 慢:物理迭代动辄需要一分钟,完全没法做实时交互。

- 脆:只要 2D 裁片在 3D 空间的初始摆放位置稍微不对,物理引擎就会导致衣服“炸开”或者穿模。

核心方法:Garment Geometry Image (GGI)

作者的直觉是:既然 2D 裁片本身就有 UV 属性,为什么不把 3D 的坐标信息直接“画”成一张图?

1. 统一的几何表征

SwiftTailor 将 3D 服装拆解为三个对齐的 2D 层(GGI):

- Semantic Map(语义图):标记哪里是袖子,哪里是领口。

- Stitching Map(缝合图):通过颜色编码告诉模型哪些边缘应该粘连。

- Geometry Image(几何图):每个像素的 RGB 值存储的是该点在 3D 空间的 (X, Y, Z) 坐标。

2. 两阶段推理流程

- PatternMaker (Stage 1):基于

InternVL-3-2B的轻量化 MLLM,负责准确理解用户的文字或图片意图,生成符合工业标准的 2D 缝制图样。 - GarmentSewer (Stage 2):这是一个基于 DPT(Dense Prediction Transformer)的图像翻译网络。它输入语义图,直接“画”出几何图。这意味着它在预测时完全不涉及复杂的物理公式,而是通过强大的先验知识“想”出了衣服缝好后的形状。

实验与结果:快且稳

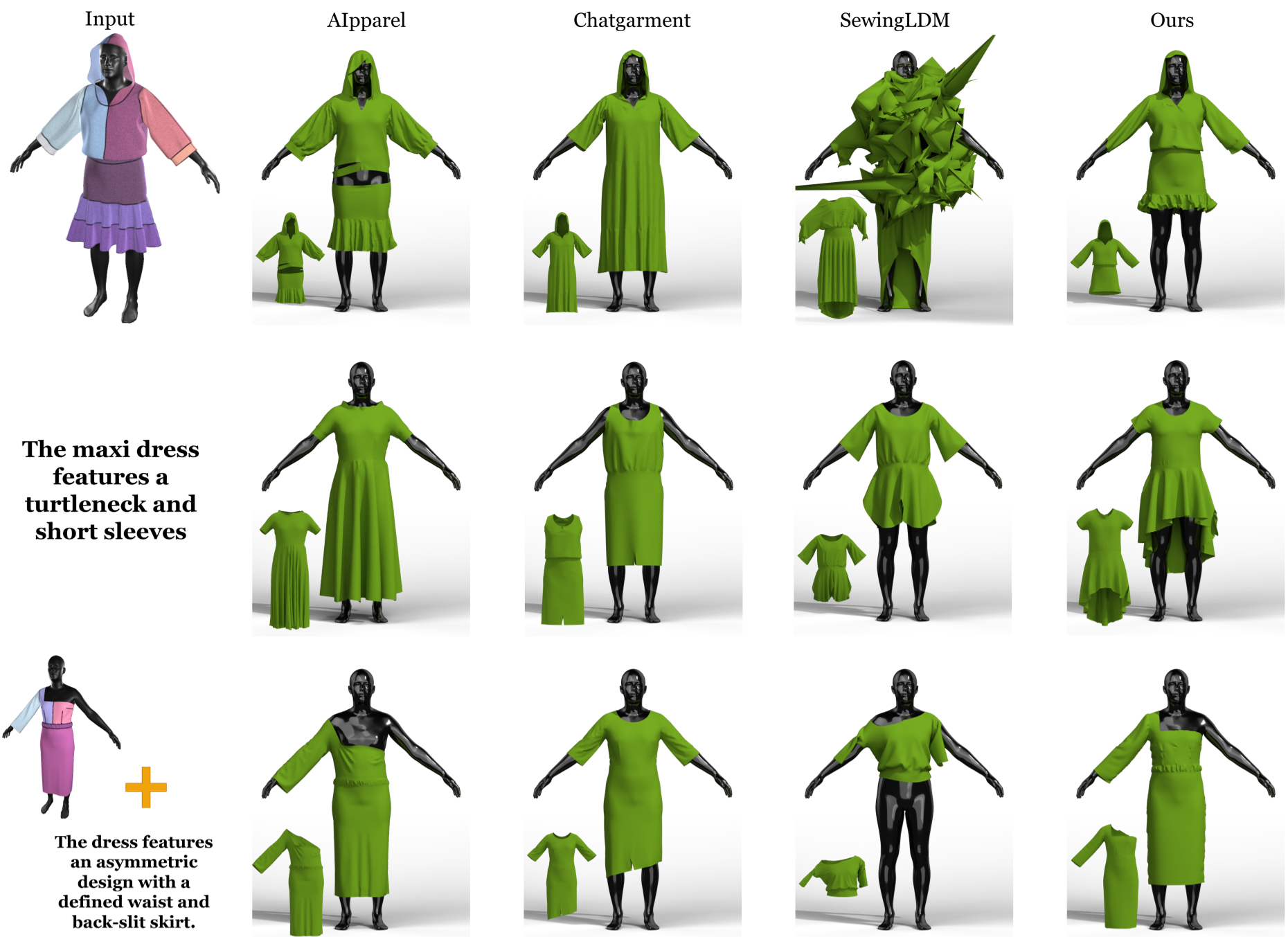

在实验中,SwiftTailor 展示了惊人的稳定性。即便是在没有物理仿真的情况下,生成的衣服在缝合处也表现得异常平滑。

- 效率对比:传统方案生成一件衣服需要 ~64 秒,而 SwiftTailor 仅需 ~14 秒。尤其值得注意的是,其 3D 构造部分从 49.5 秒缩减到了 0.02 秒!

- 几何损失:Vertex L2 降至 3.5,远低于 AIpparel 的 4.8,证明了即使模型更小,精度反而更高。

上图展示了 SwiftTailor 在处理复杂多裁片结构时的优势,相比基线,它生成的网格更加稳定,不会出现断裂或畸变。

上图展示了 SwiftTailor 在处理复杂多裁片结构时的优势,相比基线,它生成的网格更加稳定,不会出现断裂或畸变。

深度洞察

SwiftTailor 的成功在于它找到了 “规则驱动 (2D Patterns)” 与 “学习驱动 (Geometric Learning)” 的平衡点。它保留了 2D 裁片这一可解释的工业中间件,但将最耗时的缝合模拟交给了神经网络。

局限性分析: 虽然生成的模型“稳”,但作者也承认目前的方法难以捕捉到极细微的动态褶皱(High-frequency Wrinkles),因为全局平滑损失函数倾向于抑制这种细碎的变化。

总结

SwiftTailor 为 3D 服装生成提供了一个全新的范式。它告诉我们:不需要时刻死磕物理引擎,利用 2D 几何图像映射 3D 空间坐标,同样可以生成符合工业制造逻辑的数字服装。对于未来的 AR/VR 虚拟试衣、游戏换装等实时性要求极高的场景,这是一个重要的突破。