本文提出了 DynaEdit,一种基于预训练视频生成模型(如 WAN2.1, HunyuanVideo)的无需训练(Training-free)视频编辑方法。该方法首次在无需微调的情况下,实现了对视频中复杂动作、动态事件及全局效应的非刚性编辑,达到了与商用闭源模型(如 Runway Aleph)相当的 SOTA 水平。

TL;DR

传统的视频编辑技术通常只能换个“皮肤”(风格迁移),一旦涉及“让视频里的猫跳过障碍物”这种改变物体原轨迹的动作编辑,往往束手无策。Google DeepMind 近期发布的 DynaEdit 打破了这一局限。它是一种 Training-free(无需训练) 的方法,直接调用现成的文本生成视频(T2V/I2V)大模型,就能修改视频中的复杂动作、物理交互和全局动态,且在保持原始视频背景和光影的一致性上达到了新的高度。

核心痛点:为什么“动”起来这么难?

在视频编辑领域,长期存在一个平衡难题:

- Edibility(可编辑性):模型需要足够的自由度去改变物体的物理路径。

- Fidelity(忠实度):编辑后的视频必须看起来和原视频是同一个场景、同一个主角。

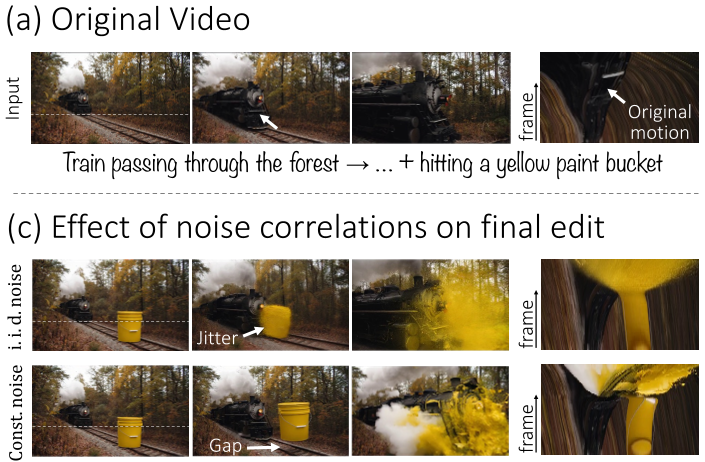

现有的 Inversion-free 方法在尝试大幅度偏移原始路径时,经常会遇到两个“拦路虎”:

- 低频偏移(Low-frequency Misalignment):因为起始噪声的随机性,视频的运镜、物体的位置会发生根本性的偏移,导致除了开头和结尾,中间内容完全和原片对不上。

- 高频抖动(High-frequency Jitter):由于每一步预测的噪声是独立的,视频会出现肉眼可见的闪烁和模糊。

关键技术:DynaEdit 的核心配方

为了解决上述问题,DynaEdit 引入了两个巧妙的模块,在 Rectified Flow 框架下实现了精准控制。

1. 相似性引导聚合 (Similarity Guided Aggregation, SGA)

在去噪的初始阶段(决定视频大轮廓的时期),模型会生成多个候选的编辑方向。SGA 不再是简单地对这些方向取平均,而是计算每个候选方向预测出的最终结果与原视频的 Cosine Similarity(余弦相似度)。

- 直觉:通过 Softmax 归一化分配权重,模型会自动“投票”给那些既完成了文本指令、又最像原视频的候选方向。这保证了即使马在跳跃,它的毛色和背景天空依然是原来的样子。

2. 退火噪声相关性 (Annealed Noise Correlation, ANC)

针对高频抖动问题,作者发现完全独立的噪声采样是罪魁祸首。

- 创新点:ANC 会随着去噪步骤的进行,逐渐增加相邻步骤之间噪声的 Correlation(相关性)。在最后决定细节颗粒度的阶段,噪声趋于一致。这种“退火”策略在不牺牲早期编辑灵活性的前提下,极大地增强了画面的时空稳定性。

实验战绩

研究团队在 WAN2.1 和 Hunyuan 1.5 等多种主流模型上测试了 DynaEdit,任务涵盖了“让球进洞”、“让宇航员捡起旗帜”等复杂的动态交互。

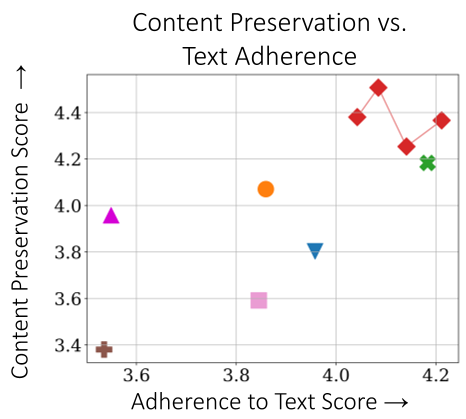

量化结果显示:

- 在 Content Preservation(内容保持) 上,DynaEdit 显著优于 SDEdit 和 FlowAlign。

- 在与闭源领头羊 Runway Aleph 的 1v1 对比中,用户在多数场景下更倾向于选择 DynaEdit 的结果,认为其动作更自然且更符合原视频逻辑。

深度洞察

DynaEdit 的成功再次印证了一个趋势:视频大模型本身就是一个物理引擎。 我们不需要重新训练它去理解“跳跃”或“碰撞”,只需要通过数学手段(如 SGA 和 ANC)去引导和约束它的去噪路径,就能把蕴含在模型权重里的物理常识“提取”出来。

然而,DynaEdit 并非完美。它高度依赖于底层 I2V 模型的生成能力。如果基础模型本身在处理精细面部或复杂物理逻辑时有缺陷,DynaEdit 也会继承这些局限性(例如论文提到的“双重帽子”Bug)。

总结

DynaEdit 为开源社区提供了一个强大的工具,让研究者能够在不需要数万张 A100 算力支持的情况下,仅凭现成的模型权重就能实现媲美顶级商业工具的视频操控效果。这对于未来的电影剪辑、动作特效创作具有深远的启发意义。