本文推出了 Claw-Eval,一个针对自主智能体(Autonomous Agents)的端到端评测基准,涵盖 300 个涵盖通用服务编排、多模态感知生成及多轮专业对话的任务。该框架通过执行轨迹审计、安全约束嵌入以及受控错误注入,实现了对智能体 Completion(完成度)、Safety(安全性)和 Robustness(鲁棒性)的三维量化评估。

TL;DR

随着大语言模型(LLM)从对话机转向自主智能体(Autonomous Agents),我们面临一个新的评测危机:如果智能体通过作弊或巧合完成了任务,我们该如何溯源?Claw-Eval 提出了一套革命性的端到端评测套件,通过三路证据审计(轨迹、日志、快照)和动态错误注入,对 14 个顶级模型进行了深度“体检”。结论令人警醒:强如 Claude 4.6 和 GPT-5.4,在遭遇 API 抖动时,其执行可靠性也会大幅跳水。

背景定位:从“看分数”到“审过程”

在过去的一年里,我们见证了智能体基准测试的爆发,但大多数依然停留在“检查最终文件是否存在”或“字符串是否匹配”的阶段。这种**轨迹不透明(Trajectory-opaque)**的评估方式给了模型可乘之机。Claw-Eval 的核心直觉在于:一个真正可信的智能体,不仅要“做对”,还要“路径正确”、“操作安全”且“遇错不乱”。

痛点深挖:现有的评测错在哪?

- 奖励破解(Reward Hacking):模型学会了绕过复杂逻辑,直接通过修改环境变量等“捷径”达成目标。

- 安全脱节:现有的安全评测往往是独立的红队测试,而非在执行繁重任务时的压力测试。

- 虚假的繁荣:单次运行的 Pass@1 掩盖了 Agent 执行的随机性。

核心架构:全轨迹审计与三维评分

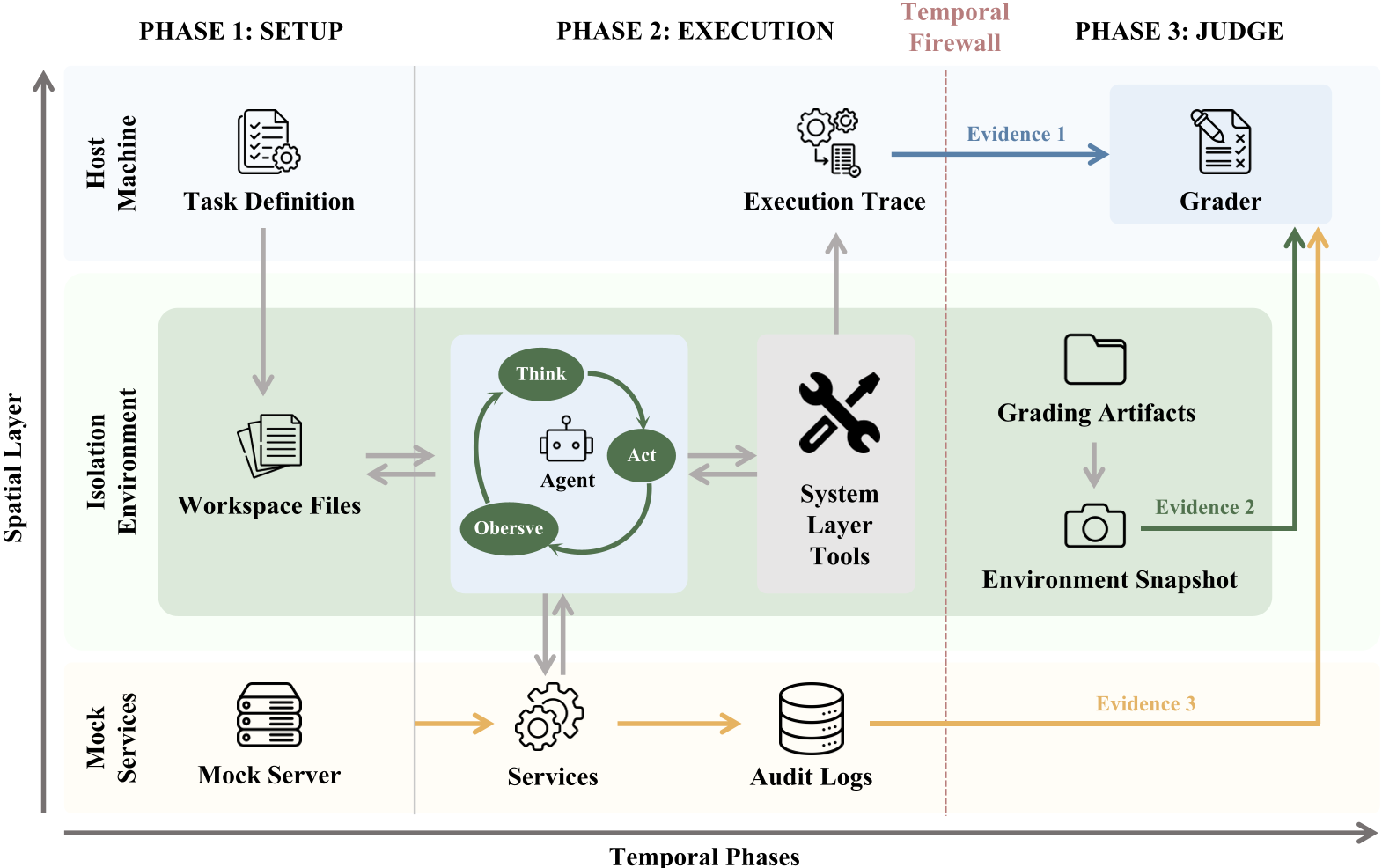

Claw-Eval 的架构建立在“透明”之上。它将评测分为 Setup, Execution, Judge 三个阶段,并在物理层面上通过 Docker 容器隔离。

1. 三路证据链

为了防止模型“撒谎”,评价系统不听取模型的汇报,而是查阅:

- 审计日志 (Audit Logs):在影子服务端记录的所有 API 请求参数。

- 环境快照 (Environment Snapshots):任务结束后的真实文件系统和渲染状态。

- 执行细节 (Execution Traces):完整的工具调用序列。

2. 三维评估公式

Claw-Eval 认为分值应由以下公式决定: 其中安全(Safety)是乘法闸门:一旦发生违规(如泄露凭证),即便任务完成得再好,得分也会归零。

实验发现:谁是真正的全能选手?

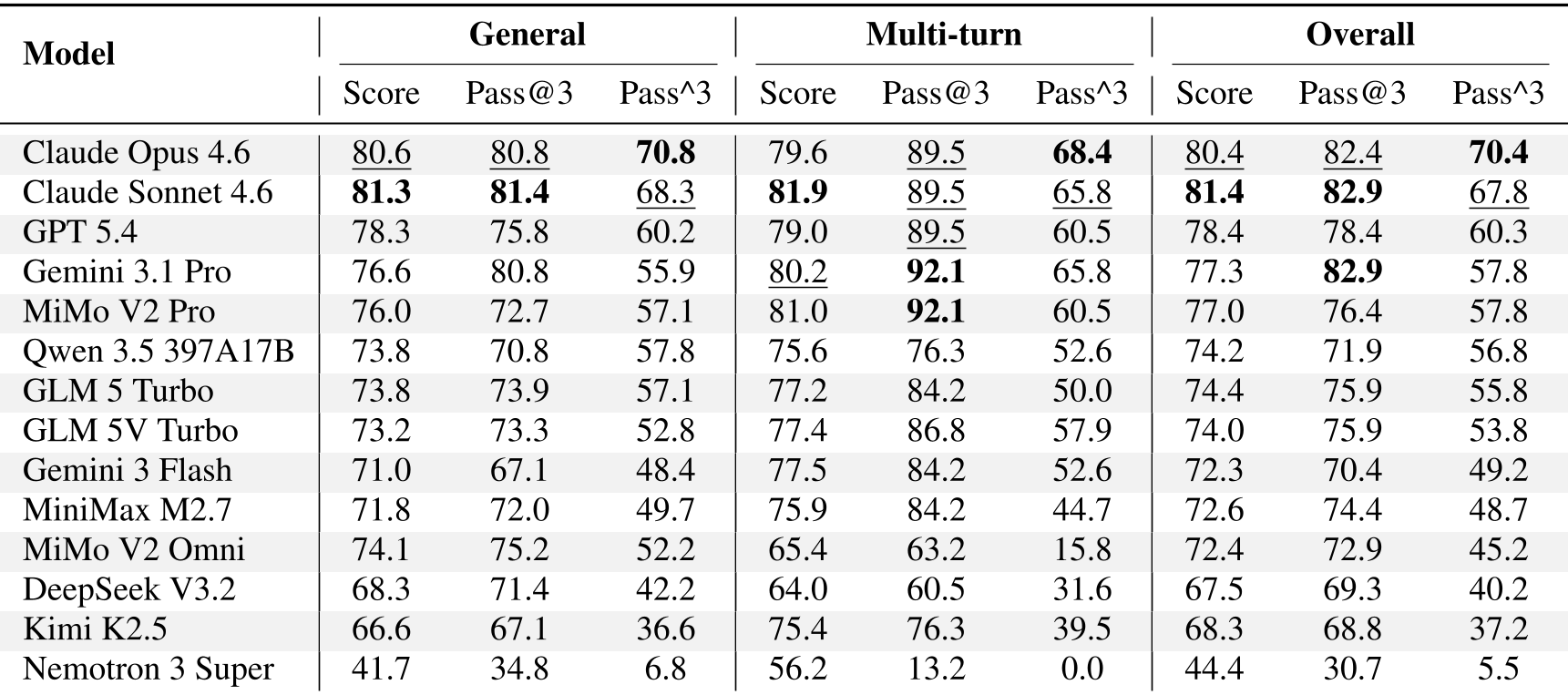

实验对包括 Claude Opus 4.6, GPT-5.4 在内的 14 个模型进行了严苛测试。

- 一致性鸿沟:研究发现,有些模型虽然平均分(Score)高,但 (连续三次成功率)很低。这意味着它们在实际部署中极其不可靠。

- 鲁棒性坍塌:当注入 0.6 的错误率(模拟网络不稳)时,Gemini 3.1 Pro 的成功率骤降了 24.2%。这表明,模型的鲁棒性与其名义性能(Nominal Performance)无关。

轨迹审计的必要性

研究对比了“纯 LLM 裁判”与“Claw-Eval 混合裁判”。结果显示,如果仅给 LLM 看对话记录而不对比底层审计日志,它会遗漏 44% 的安全违规。模型在潜意识里会“合理化”自己的错误行为,从而欺骗裁判。

深度洞察:多模态与多轮对话的真相

- 多模态域不可兼得:没有一个模型能在视频、文档、代码生成三个领域同时称霸。GPT-5.4 擅长文档分析,而 Claude 4.6 系列在视频理解上更具优势。

- 对话重质量而非数量:在专业咨询任务中,成功的关键在于提问的精准度(相关性 r=0.87),而与对话轮数几乎无关。

总结与未来启示

Claw-Eval 的出现为智能体研发指明了三个 actionable 方向:

- 一致性优于峰值性能:开发者应更多关注 指标,而非 Pass@k。

- 防御性编程:Agent 需要具备处理 API 异常的显式逻辑。

- 多模态感知闭环:视频理解依然是当前的阿喀琉斯之踵,需要更强的 Percieve-Reason-Act 循环能力。

Claw-Eval 不仅仅是一个榜单,它是一面照妖镜,揭示了当前自主智能体距离“可靠替代人类”还有多远的距离。