本文提出了 CoMe,一种基于置信度的 3D Gaussian Splatting (3DGS) 网格提取框架。该方法引入了自监督置信度机制和颜色/法向方差损失,在不依赖大模型先验的情况下,实现了 SOTA 级别的无界场景高质量网格重建。

TL;DR

在 3D 重建领域,从 3D Gaussian Splatting (3DGS) 中提取高质量网格(Mesh)一直是效率与精度的博弈。CoMe (Confidence-based Mesh Extraction) 突破了这一瓶颈。它无需依赖笨重的预训练模型(如单目深度估计),仅通过一套巧妙的自监督置信度框架和方差约束策略,在保持 20 分钟极速优化的同时,刷新了无界场景网格重建的 SOTA 记录。

1. 痛点:被“外观”欺骗的“几何”

3DGS 之所以快,是因为它将几何与外观耦合在各向异性的高斯基元中。但在处理复杂的高频视角相关效果(如金属反光、半透明遮挡)时,这种耦合成了“毒药”:模型往往倾向于通过在表面后方堆叠大量透明高斯球来“伪造”虚假的光影效果,而非构建真实的物理表面。

先前的方法(如 PGSR, MiLo)尝试引入多视图几何约束,但这带来了巨大的计算开销,或者导致细节被过度平滑。

2. 核心技术:自监督置信度平衡

CoMe 的核心直觉是:并非所有的像素点对于几何生成的贡献都是平等的。

动态平衡损失函数

作者为每个高斯基元赋予了一个可学习的置信度值 。通过 Alpha-blending 渲染出置信度图 ,并构造如下损失: 这个公式的物理意义非常明确:当某区域光度误差 很大且难以通过几何修复时,系统会学会减小 (即承认这一块“我不确定”),从而避免错误的梯度强制更新几何。

置信度引导的 Densification

传统的梯度引导加密(Densification)在模糊区域会疯狂复制高斯球。CoMe 通过置信度动态调整阈值,有效防止了在不确定区域的过度分发(Over-densification),保证了模型的紧凑性。

3. 消除“重影”:方差减少损失

为了解决 Alpha-blending 导致的“空间重影”现象,CoMe 引入了颜色和法向的方差损失。

- :强制射线路径上的高斯基元颜色尽可能接近渲染终点颜色,抑制表面后的残留背景色。

- :增强高斯基元法线与局部表面的共面性,这对室内平面的重建效果立竿见影。

4. 实验战绩:速度与精度的双赢

在最具挑战性的 Tanks & Temples 数据集上,CoMe 的 F1-Score 到达了 0.521,大幅领先于之前最好的无界场景方法 GOF 和 SOF。

| 方法 | 坦克与寺庙 (F1) | 优化耗时 | | :--- | :--- | :--- | | PGSR (TVCG'25) | 0.496 | 28 min | | MiLo (TOG'25) | 0.485 | 60 min | | Ours (CoMe) | 0.521 | 18 min |

关键图表分析

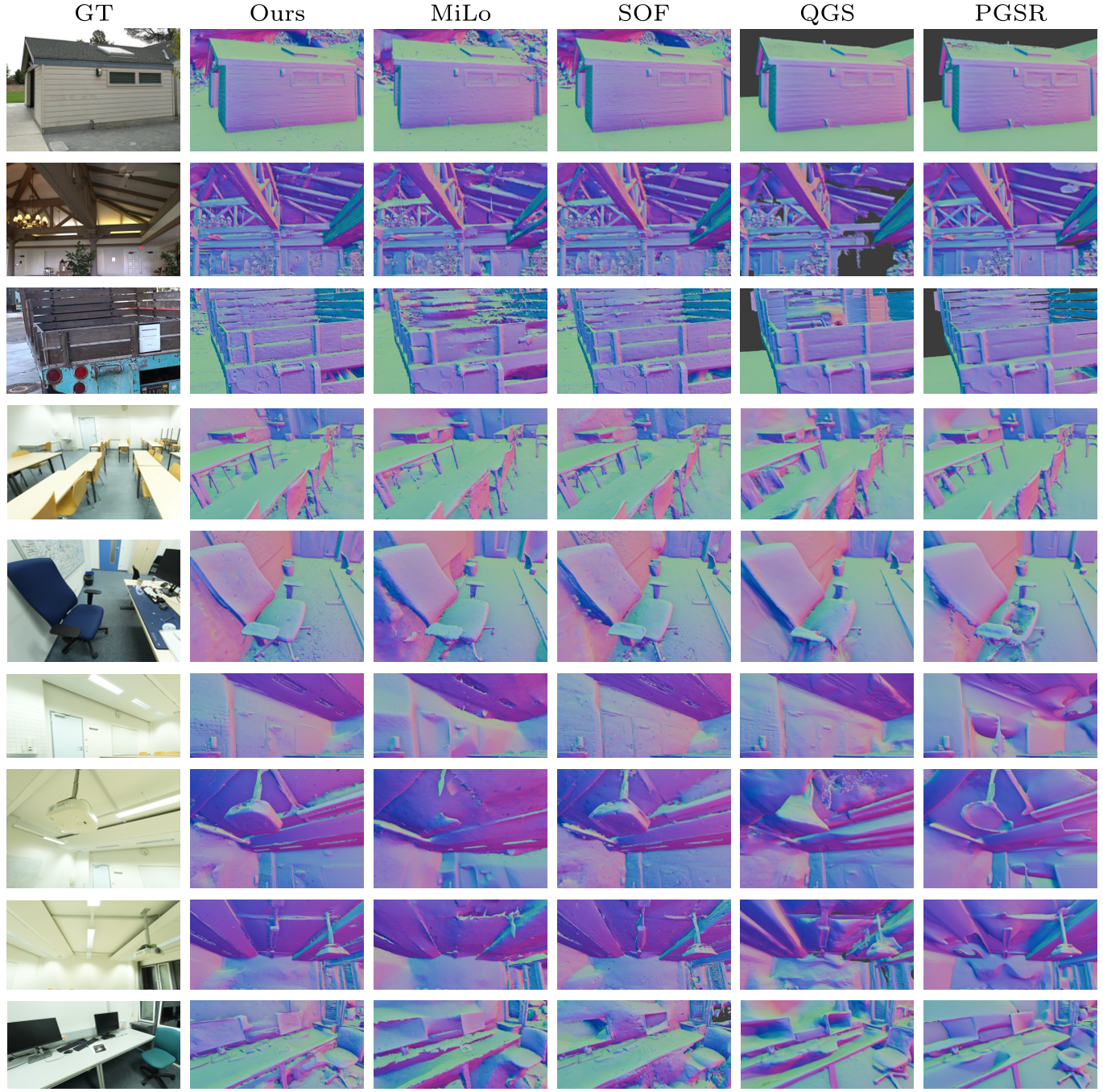

从定性对比图中可以看出,CoMe 提取的网格在保持拓扑完整性的同时,能够捕捉到更细微的几何结构(如旗杆、薄片状物体),而其他方法往往会将其识别为噪声或平滑掉。

5. 深度洞察

CoMe 证明了无需外部强先验也可以通过统计学手段(方差与置信度)从 3DGS 中“榨取”出高质量几何。其改进的 D-SSIM 解耦策略(仅在亮度项使用外观补偿,保留对比度和结构项的原始几何信息)是一个极具工程价值的发现,解决了 3D 重建中长期存在的光照一致性难题。

局限性

- 视角稀疏性:在极度稀疏的视角下,自监督机制可能因缺乏足够证据而失效。

- 远景处理:远景背景的加密策略仍有优化空间。

结论

CoMe 不仅仅是一个网格提取算法,它为 3DGS 的优化提供了一种更优雅的统计视角。在 20 分钟内完成 SOTA 级别的无界场景重建,预示着实时高质量三维重建正迈向新的台阶。