本文揭示了在机器人持续学习中自发涌现的“自我”概念。研究通过让四足机器人在模拟环境中循环学习行走、扭动和摆动三种行为,发现其神经网络中形成了一个高度稳定的不变子网络(Persistent Subnetwork),在多任务切换中保持结构恒定,扮演了“身体图式”的角色。

TL;DR

哥伦比亚大学团队的一项最新研究表明,当机器人被要求在漫长的生命周期中学习多种截然不同的技能时,其神经网络内部会自动分裂成两个部分:一个负责应对当下的特定任务(如:我现在该怎么摆动),而另一个则形成了一个恒定的核心——它不随任务改变,专门描述“我是谁”以及“我的身体物理特性”。这个核心,被研究者称为涌现出的“自我”。

背景定位:寻找“我”的内生签名

自迪卡尔提出“我思故我在”以来,哲学与人工智能领域一直在追问:什么是自我的内在表征?在具身智能(Embodied AI)中,常规做法是人工设计一个“自模型”模块。但本文作者 Hod Lipson 教授的团队换了个思路:如果我们不干预,单纯让一个神经网络在不断改变的任务(行走、旋转、跳跃)中历练,它会自发生长出一个代表“自我”的结构吗?

核心直觉:不变性即“自我”

作者的物理直觉非常深刻:我们的经历中,最持久、变化最慢的部分就是“自我”。你游泳、跑步、写字,技能在变,但承载这些技能的“身体”和“视角”是不变的。

为了验证这一点,研究人员设置了对比实验:

- 静态组:机器人只学“走路”,反复训练。

- 持续学习组:机器人在“走路 -> 扭动 -> 摆动”三个任务间循环切换。

架构解析:如何从“神经网络面团”里洗出“面筋”?

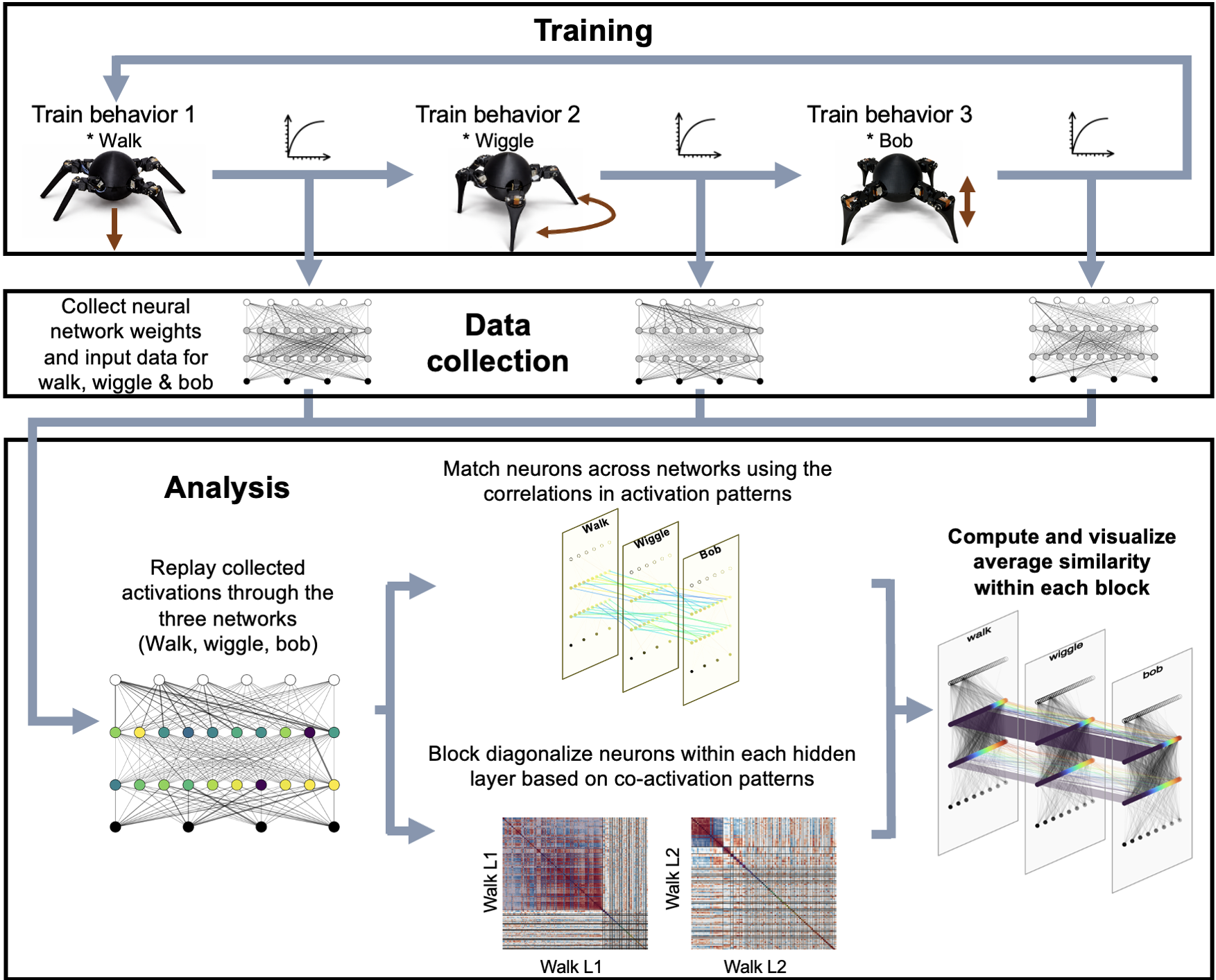

如何从一个全连接的密集网络(MLP)中找出这个“自我”?作者将其转化为一个图论与统计问题:

- 神经元对齐(Permutation Alignment):神经网络具有排列对称性,不同任务下的同一神经元序号可能不同。作者利用匈牙利算法,通过激活值的余弦相似度,将不同阶段的神经元进行精准匹配,建立“神经元家族”。

- 共激活分析:计算神经元两两之间的相关性。如果两个神经元总是一起放电,它们就被归为一个子网络(Subnetwork)。

- 持久性量化(Persistence Score):通过比较子网络在任务切换前后的激活模式和连接结构的稳定性,来筛选出那个最稳固的“核心”。

图 1:持续学习训练流与神经元稳定性分析Pipeline。注意左侧展示的三个行为:行走 (Walk)、扭动 (Wiggle)、摆动 (Bob)。

图 1:持续学习训练流与神经元稳定性分析Pipeline。注意左侧展示的三个行为:行走 (Walk)、扭动 (Wiggle)、摆动 (Bob)。

实验战绩:涌现的“自我”清晰可见

研究发现,持续学习组的网络结构呈现出明显的分层倾向。

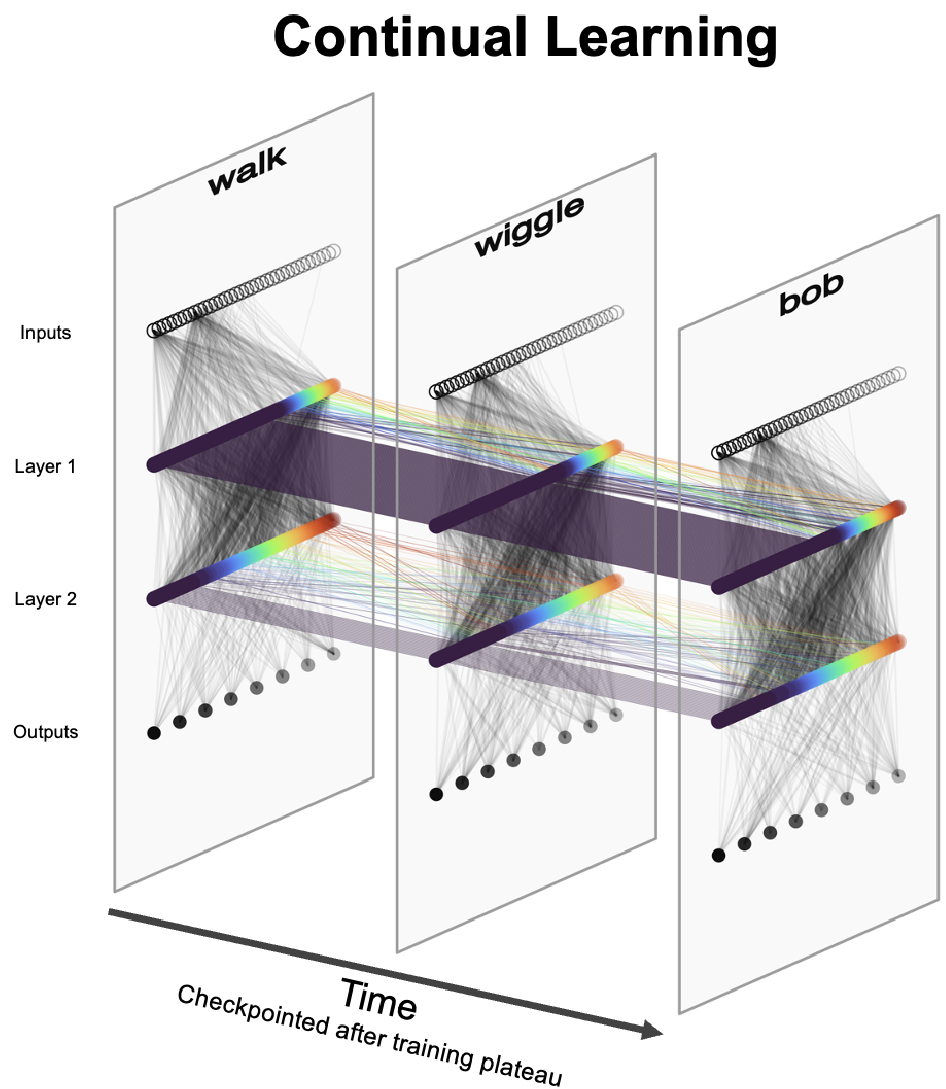

- 第一层的统治力:在网络的第一隐藏层中,出现了一个占据约 150 个神经元中的 80 个的巨大子网络。无论任务怎么变,这些神经元的“朋友圈”(连接关系)和响应方式都极其稳定。

- 塑料般的任务区:与此同时,剩余的神经元则表现出极高的可塑性,随任务切换剧烈重组。

图 2:左侧为单一任务组,神经元流向散乱(Spaghetti-like);右侧为持续学习组,紫色流带清晰地展示了一个贯穿始终的“持久自我”子网络。

图 2:左侧为单一任务组,神经元流向散乱(Spaghetti-like);右侧为持续学习组,紫色流带清晰地展示了一个贯穿始终的“持久自我”子网络。

在量化分析中,持续学习产生的“自我核心”稳定性比普通基准高出 16.9%,且在统计学上极其显著(p 远小于 0.001)。更有趣的是,这种“自我”并不存在于只学一件事的机器人脑子里——多样性体验是“自我”诞生的催化剂。

深度洞察:这意味着什么?

这项研究所展示的不仅仅是一个 AI 实验。

- 理解模块化:它揭示了模块化结构是如何在“压力”下产生的。当模型容量有限且需要处理多项任务时,为了提高重用率,它必须剥离出那个共性的“身体底座”。

- 应用潜力:这个“自我”子网络本质上是机器人的“数字孪生”在隐空间的映射。如果后续我们将该部分权重锁定(Freeze),只微调任务区,或许能彻底解决类脑计算中的灾难性遗忘问题。

- 局限性:目前的行为集合较为紧凑。未来需要观察在更复杂的类人机器人或更多样化的操作任务中,这种“自我”是否会进一步分裂成更高维的概念。

总结

生命之美在于多变环境中的不变初心。这项工作证明,即使是最标准的强化学习算法,只要给予足够的挑战和体验广度,机器也能“悟”出自己的存在。

本文由资深学术主编重构。如需获取更多该论文的实验参数(如 SAC 学习率、IsaacLab 环境配置),请参考原论文附录。