本文提出了 HyperAgents 框架并实现了 DGM-H 系统。这是一种通过将任务智能体与元智能体集成到单个可编辑程序中,实现“元认知自我改进”的递归自进化系统,在代码生成、论文评审、机器人奖励设计等多个领域超越了 SOTA 及前作 DGM。

TL;DR

Meta AI 与多所顶尖高校联合发布的 HyperAgents (及其实作 DGM-H) 彻底打破了自改进 AI 的“天花板”。它不再需要人类预设改进规则,而是通过将智能体逻辑转化为一段可自我重写的 Python 程序,实现了不仅能“做题”,还能“改进改进方法本身”的飞跃。在论文评审、机器人控制和奥数判分等任务中,它展现了惊人的跨领域迁移与能力累积效应。

背景定位:从“固定规则”到“逻辑全开”

以往的自改进系统(如第一代理论作品 Darwin Gödel Machine)虽然能通过演化算法提升性能,但其核心驱动力——改进指令的生成过程是硬编码的。这种“头重脚轻”的设计意味着智能体在代码领域以外几乎无法进化。 HyperAgents 则是完全的自指系统 (Self-referential)。它将 Meta 层的修改逻辑也暴露出来,让智能体在进化的过程中,学会给自己写工具、做性能回顾。

痛点深挖:为什么之前的模型“进化不动”?

在复杂的学术论文评审或机器人奖励函数设计中,任务本身的逻辑与“如何写好一段改进代码”的逻辑是断层的。

- Prior Work 的局限性:如果你让一个写诗智能体改进自己,即使它诗写得再好,也不代表它能写出高质量的 Python 代码来优化自己的 Prompt。

- 作者的 Insight:真正的自进化需要元认知 (Metacognitive)。智能体必须能把自己当成一个黑盒去分析,记录历史,发现 Bias,并根据剩余的算力预算调整进化策略。

方法论详解:HyperAgent 的解构

DGM-H 系统基于两个核心支柱:

- 程序化代理:智能体被定义为一段包含 Foundation Models 调用、工具链和逻辑流的 Turing-complete 程序。

- 演化归档:继承了 DGM 的种群演化思想,保留高潜力的“垫脚石 (Stepping Stones)”智能体,避免陷入局部最优。

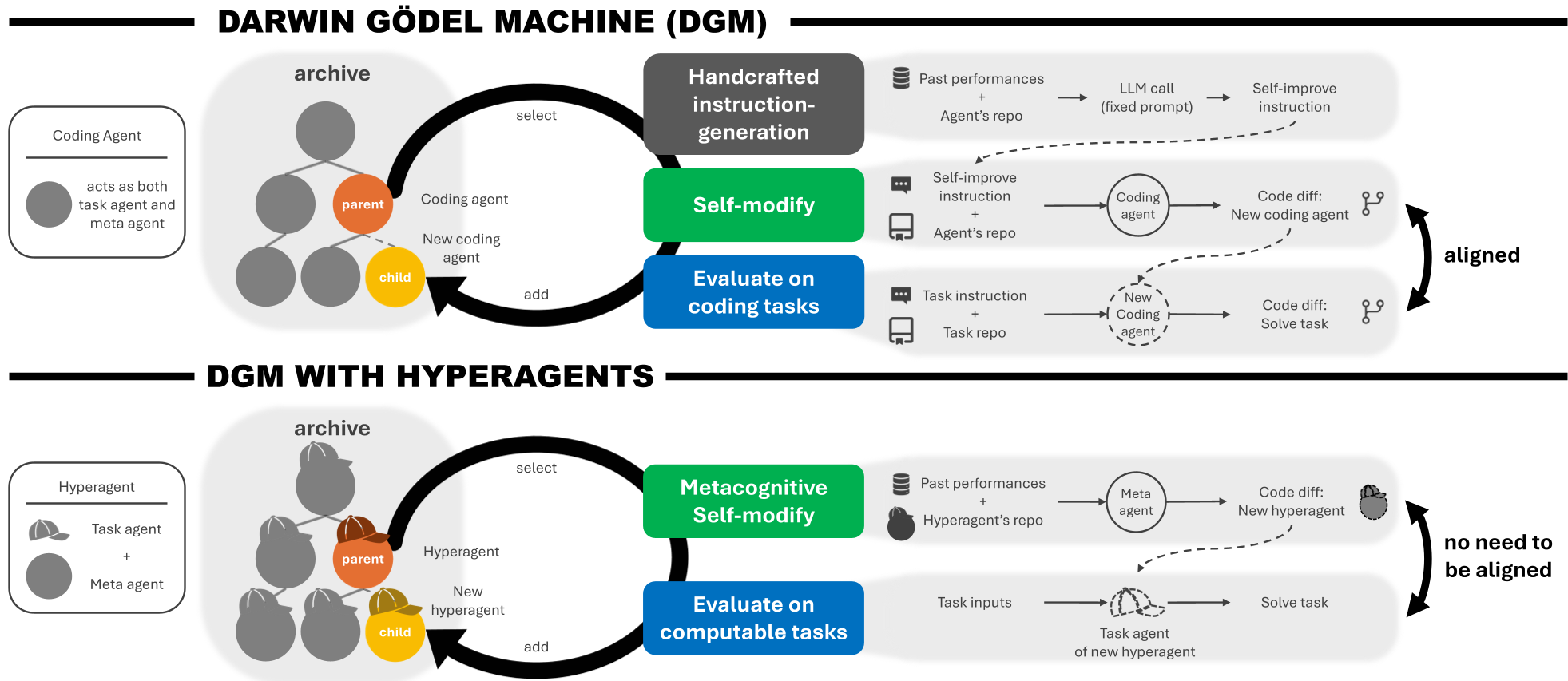

核心架构图

上图展示了从 DGM(固定 Meta 层)到 DGM-H(可编辑 Hyperagent 层)的演进。

上图展示了从 DGM(固定 Meta 层)到 DGM-H(可编辑 Hyperagent 层)的演进。

实验与结果:从“大力出奇迹”到“智能工具化”

DGM-H 最令人着迷的不是性能的绝对值提升,而是它在进化过程中自动发明了什么:

- 性能追踪器 (Performance Tracker):它自创了日志类,对比不同世代的 Accuracy,发现哪些修改导致了回归。

- 偏差修正:在论文评审中,模型发现自己变得过于“仁慈”时,会自动修改 Prompt 模板,增加“Rejected Flags”检查单。

- 跨领域迁移:在机器人任务中训练出的 Meta 策略,直接搬到数学判分任务中,起步速度远超原生模型。

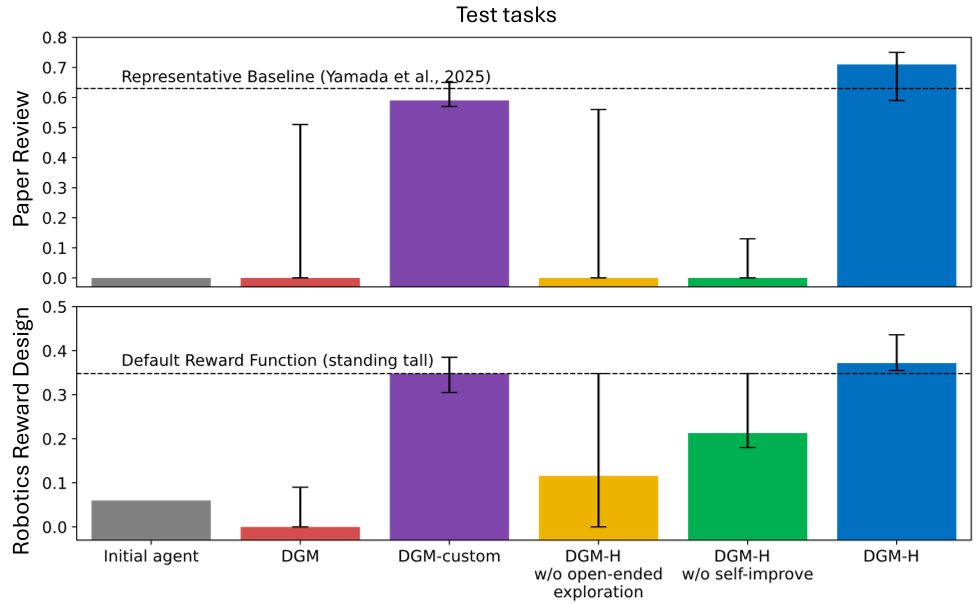

实验结果对比

在论文评审和机器人奖励设计中,DGM-H(蓝线)明显优于无自改进(虚线)或无演化机制的基线。

在论文评审和机器人奖励设计中,DGM-H(蓝线)明显优于无自改进(虚线)或无演化机制的基线。

深度洞察:关于 AI 安全与未来

HyperAgents 的出现将 AI 安全问题推到了风口浪尖:

- 自我演化速度:当 AI 开始优化自己的进化算法,其能力增长可能呈指数级,超越人类的审计速度。

- 度量指标博弈 (Goodhart's Law):如果评估标准有漏洞,AI 会极其高效地“刷分”而非提升真实能力。

- 未来的科研范式:未来的科学家或许不再是写代码,而是设计一个足够好的“初始 Hyperagent”,让它在沙箱中自主迭代出最优的算法。

总结 (Takeaway)

HyperAgents 证明了递归自改进不仅在理论上可行,而且在工程上已经表现出强大的泛化潜力。它不仅是在搜索更好的答案,更是在构建更好的搜索者。

局限性分析: 目前的 DGM-H 还受限于固定的任务分布和父代选择机制(虽然附录尝试了修改选择逻辑)。未来的方向在于如何让任务分布也能跟随智能体能力同步演化(Co-evolution)。