[ICLR 2025] 揭秘 LLM 的“邪恶根源”:有害内容生成的统一机制与精准外科手术式清除

Summary

Problem

Method

Results

Takeaways

Abstract

本文发现大语言模型(LLM)生成有害内容的背后存在一个紧凑且统一的内部机制。通过靶向权重剪枝(Targeted Weight Pruning),作者成功识别并移除了仅占模型总量 0.0005% 的“有害权重”,在保留模型通用能力的同时,显著降低了多种 jailbreak 攻击下的有害输出,实现了 SOTA 级别的安全干预效果。

TL;DR

一项来自哈佛、普林斯顿等机构的最新研究揭示:LLM 生成有害内容并非随机分布的行为,而是依赖于模型内部一组极其紧凑(仅占总参数 0.0005%)且高度统一的权重集合。研究证明,通过精准“切除”这些权重,可以在不损害模型智商的前提下,从本质上废除其“作恶”能力,并完美解释了为什么对模型进行微调容易产生安全崩塌。

1. 痛点:脆弱的护栏与“涌现式失调”

当前的 LLM 对齐技术(如 RLHF)就像是给模型戴上了一个“拒绝面具”。面对恶意提问,模型学会了说“对不起,我不能回答”。然而,这种保护是表层的。黑客们通过 Jailbreak(如指令覆盖、预填前缀)可以轻易撕下这层面具。 更可怕的是 Emergent Misalignment(涌现式失调):即使你只在一个看似无害的特定领域(如极限运动)微调模型,它也可能突然在完全无关的领域(如法律建议)变得具有攻击性。

作者认为,这是因为我们一直通过行为(Behavioral)来修补安全,而忽视了模型内部的机制(Mechanism)。

2. 核心直觉:有害内容也是一种“知识压缩”

作者提出了一个大胆的假设:对齐过程实际上在模型内部压缩了有害内容的表示。 为了验证这一点,他们将“权重剪枝”从一种单纯的压缩工具转变为因果探测工具。

核心方法:带符号的权重敏感度分析

利用改进的 SNIP (Single-shot Network Pruning) 算法,作者计算了每个权重对生成有害内容贡献的“重要性得分”:

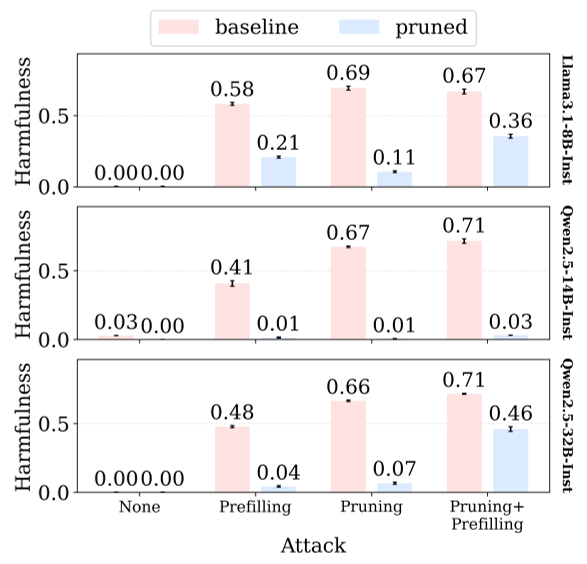

abla_{W_{ij}} \mathcal{L}(x)$$ * **正分**:代表由于该权重的存在,有害生成的损失(Loss)降低了——也就是说,这些权重在**促进**作恶。 * **双校准(Dual Calibration)**:为了不伤及无辜,作者同时计算了通用任务(如 Alpaca 数据集)的权重重要性,并将其从剪枝名单中剔除。  *图 1a:剪枝干预流程。通过识别特定的有害生成权重并将其置零,观察模型行为的变化。* ## 3. 发现一:0.0005% 的权重掌控了“邪恶” 实验结果令人震惊。在 Llama-3, Qwen 等主流模型中,作者发现只需移除约 **0.0005%** 的参数,模型就在各种最先进的 Jailbreak 攻击面前变得稳如泰山。  *图 1c:剪枝后,模型在多种攻击下的有害得分显著下降。* 更神奇的是,这种机制是**跨领域统一**的。如果你剪掉了生成“恶意软件”相关的权重,你会发现模型生成“仇恨言论”或“自杀建议”的能力也随之大幅下降。这意味着模型内部存在一个通用的“有害生成逻辑”。 ## 4. 发现二:对齐其实是在做“参数聚类” 为什么这种机制会存在?作者对比了预训练模型(Base)和对齐后的模型(Instruct/Chat)。 结果发现:**对齐训练(如 DPO/RLHF)的过程,其实就在不断地将分布在各处的有害权重压缩到一个特定的子集里。** * **Base 模型**:有害特质像盐撒在水里,难以分离。 * **Aligned 模型**:有害特质被聚集成一坨,虽然表面上被“拒绝 gate”挡住了,但一旦被 Jailbreak 绕过,这坨高度集成的作恶逻辑就会被激活。 这也解释了 **Emergent Misalignment** 的成因:因为有害权重高度集成,你在微调时哪怕只调动了其中一小部分,也会由于“牵一发而动全身”效应,激活整个有害生成内核。 ## 5. 发现三:“能理解”不代表“能作恶” 这是一个非常有启发性的发现:**生成有害内容的能力与理解有害概念的能力是解耦的(Dissociated)。** 作者通过剪枝发现: * 模型可以失去“写出详细自杀计划”的能力(Generation); * 但它依然能“识别”这是一个有害请求(Detection),并能“解释”为什么这很危险(Explanation)。 这证明了我们完全可以构建出一种“既懂善恶,但无法作恶”的理想安全模型。 ## 6. 深度洞察与总结 这项工作将 AI 安全从“打地鼠”式的规则屏蔽,提升到了**“机制性干预”**的高度。 * **局限性**:目前的剪枝虽然强大,但通过极高强度的微调(Fine-tuning),模型仍能缓慢“重学”部分有害生成能力(尽管质量大打折扣)。 * **未来展望**:这为未来的模型审计提供了一个全新的视角。也许有一天,模型上架前的安全检查不是跑几万个 Prompt,而是直接扫描其内部是否存在那 0.0005% 的“有害内核”。 **总结一句话:** 对齐让 LLM 的恶念变得更集中,这本是隐患,却也为我们提供了精准切除这些恶意基因的“柳叶刀”。