本文提出了 MCLR,这是一种通过在训练阶段显式最大化类别间对数似然比(Inter-Class Likelihood-Ratio)来增强视觉生成模型类条件建模的方法。该方法在扩散模型和自回归模型上均显著提升了生成样本的保真度,且无需在推理时使用 Classifier-Free Guidance (CFG)。

TL;DR

传统的扩散模型(Diffusion Models)在生成图像时非常依赖一种叫 Classifier-Free Guidance (CFG) 的推理技巧,否则生成的图片往往“类特征模糊”。密歇根大学的研究团队通过提出 MCLR (Maximum Inter-Class Likelihood-Ratio) 训练目标,在数学上证明了 CFG 本质上是一种隐式的训练对齐(Alignment)过程。通过在运行前进行 MCLR 微调,模型无需在采样时进行昂贵的 CFG 计算,即可获得相同甚至更好的图像保真度。

核心痛点:为什么 Diffusion 离不开 CFG?

在理论上,基于 Denoising Score Matching (DSM) 训练的扩散模型应该能完美恢复真实的类条件分布 。但在现实中,我们发现:

- 类别塌陷:不同类别的初始噪声在去噪后,往往呈现相似的全局布局,类特定的细节被弱化或丢失。

- 依赖 CFG:为了让生成的“狗”更像“狗”,必须在推理时手动叠加一个引导项。

作者发现,这背后的物理直觉是类别间的区分度(Inter-Class Separation)不足。模型并没有真正“压榨”标签 提供的信息。

方法论详解:MCLR 与对齐理论的统一

1. MCLR 的直觉

作者提出了一个非常直接的目标:在训练时,不仅要求样本在正确类别 下似然度高,还要通过最大化对数似然比 ,显式地压低它在错误类别 下的概率。

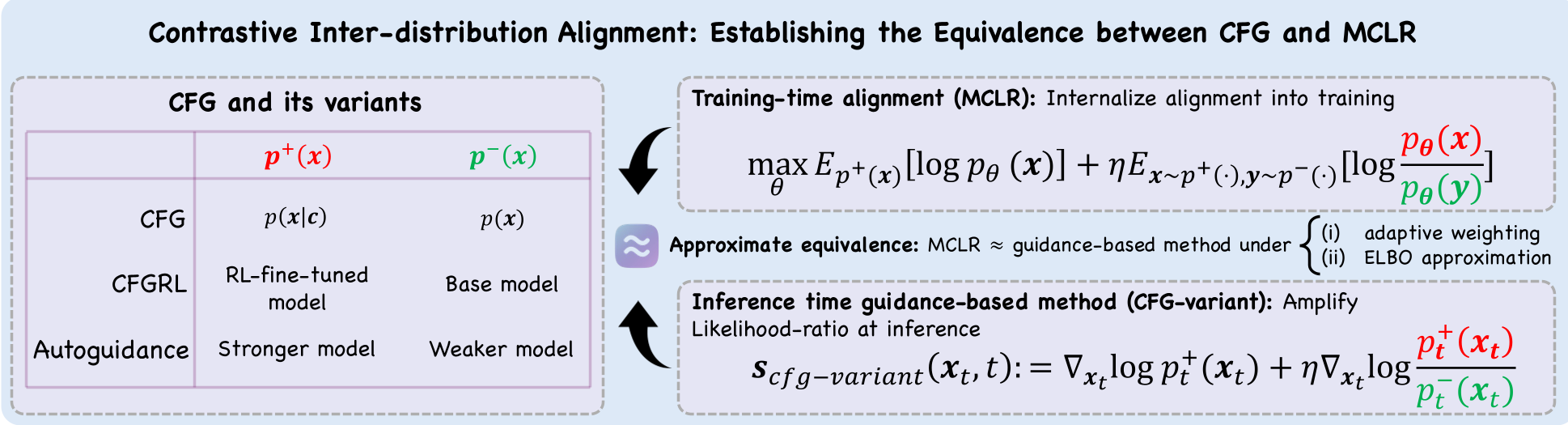

图 1:将 CFG 变体统一在对比对齐(Contrastive Alignment)框架下

图 1:将 CFG 变体统一在对比对齐(Contrastive Alignment)框架下

2. 精妙的理论证明

这是本文最惊艳的部分。作者通过 Theorem 3 证明了: CFG 引导的 Score 居然是一个样本自适应加权 MCLR 目标的唯一最优解。 这意味着,我们以前认为的“推理黑箱技巧”,其实是在做一种实时的对齐优化。这一发现填补了扩散模型理论中“为什么 CFG 有效”的长期空白。

实验战绩:无引导也能 SOTA

在实验中,MCLR 展现出了极强的效能:

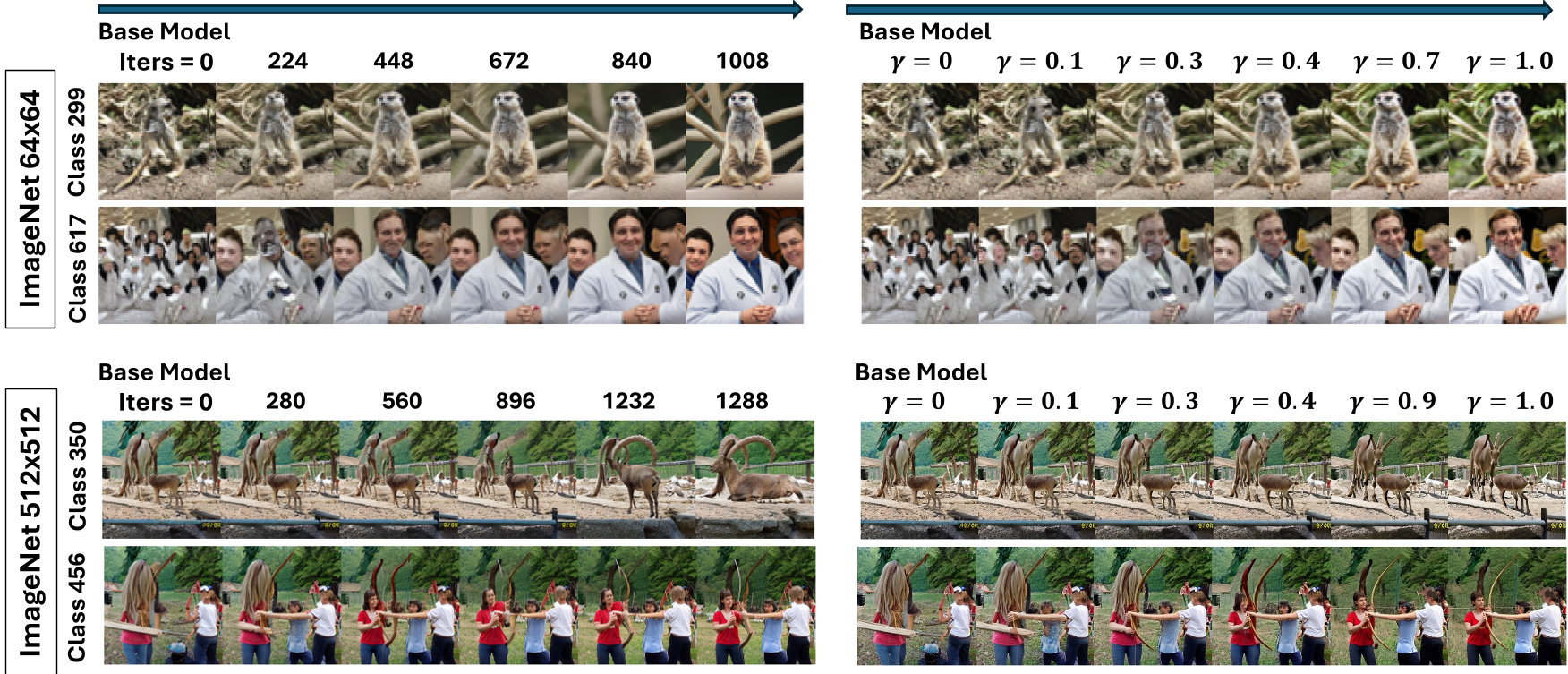

- 视觉效果:随着 MCLR 训练步数的增加,生成的图像如同调大了 CFG Scale 一样,类别特征逐渐鲜明。

- 定量指标:在 EDM2-L 模型上,MCLR 显著优于之前的训练侧对齐方法(如 DPO、CCA),在 ImageNet-512 上将 FD-DINOv2 指标从 67.70 优化至 42.50。

图 2:MCLR 训练过程中的类特征进化,效果等同于增加 CFG 强度

图 2:MCLR 训练过程中的类特征进化,效果等同于增加 CFG 强度

此外,由于推理时不再需要计算两个 Score(Conditional 和 Unconditional),推理速度相比传统的 CFG 采样可以提升近 2 倍。

深度洞察:训练侧对齐 vs. 推理侧引导

MCLR 的成功引发了一个深刻的思考:对齐应该发生在什么时候?

- CFG 的优势在于灵活,可以在采样时动态调整 Fidelity 和 Diversity 的平衡。

- MCLR 的优势在于高效,它将对比信号内化到了模型参数中。

作者指出,虽然目前的 MCLR 在 FD 指标上仍略逊于最强状态的 CFG,但它展现了巨大的潜力,特别是对于实时生成任务,消除推理开销具有极大的工程价值。

总结

MCLR 不仅是一个实用的训练目标函数,更是一次深刻的理论回归。它告诉我们,视觉生成模型的下一步,也许不再是发明更复杂的采样器,而是如何更好地利用标签信息进行类对比学习。

主编点评:本文在数学严密性和物理直觉之间找到了极佳的平衡。证明 CFG 与 MCLR 等效的部分,不仅是学术上的优美,更为生成模型的工程化减负指明了方向。