本文推出了 UniDex,这是一个面向通用灵巧手控制的机器人基础套件。它包含一个跨 8 种灵巧手、拥有 5 万余条轨迹的大规模机器人中心数据集 UniDex-Dataset,以及一个基于 3D 视觉-语言-动作(VLA)的统一策略模型 UniDex-VLA。

TL;DR

清华大学、上海期智研究院等机构的研究者提出了 UniDex,一套旨在解决灵巧手控制难题的基础套件。它通过将海量人类第一视角视频“翻译”为机器人轨迹,训练了一个支持 8 种不同灵巧手硬件的通用模型。其核心突破在于统一动作空间 FAAS 和 3D 点云 VLA 架构,使得机器人能像人类一样熟练使用剪刀、咖啡壶和喷雾瓶。

背景定位

在机器人学中,灵巧操作(Dexterous Manipulation)一直被视为“珠穆朗玛峰”。相比结构简单的二指夹爪,具有 20+ 自由度的灵巧手能完成更复杂的工具使用任务,但其数据采集成本极高,且不同品牌(如 Shadow Hand, Allegro)之间无法直接复用算法。UniDex 的出现,标志着灵巧操作从“单任务特定模型”向“通用基础模型”跨越。

痛点深挖:为什么灵巧手这么难搞?

- 数据孤岛:收集 50 条高质量遥操作数据可能需要一个人工作数天。

- 硬件异构性:你在 Inspire 手上调好的动作,换到 Wuji 手上就完全抓瞎,因为坐标系和关节点分布完全不同。

- 视觉-运动缝隙:人类视频虽然多,但人手和机械手的构造天差地别,直接模仿会导致物理上的不协调。

核心机制:UniDex 的“炼金术”

1. FAAS:抹平硬件差异的“普通话”

作者提出了 Function-Actuator-Aligned Space (FAAS)。不同于传统的 URDF 关节点空间,FAAS 基于功能进行映射。无论灵巧手长什么样,大拇指的对捏、食指的卷曲在 FAAS 空间中都拥有相同的坐标索引。这让模型学习的是“功能语义”而非单纯的电机值,从而实现了 Zero-shot 跨手迁移。

2. 人机转换流水线 (Human-to-Robot Transformation)

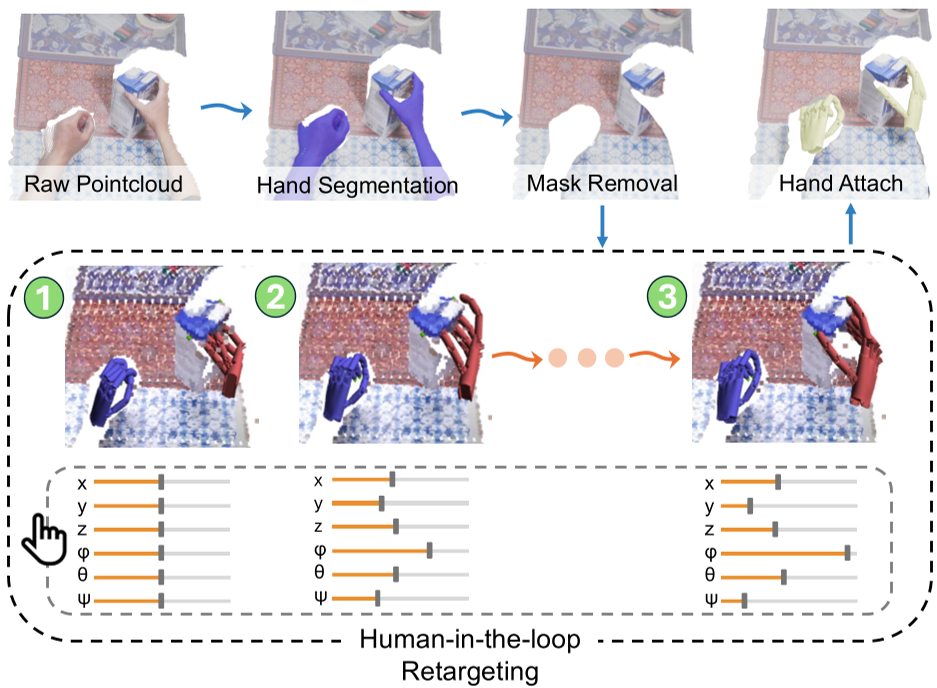

为了利用海量的人类视频,UniDex 采用了两步走战略:

- 人机在环重定向:利用 IK 算法对齐指尖轨迹,并加入轻量级的人造 GUI 手动校准,确保机器手的接触点不仅准确而且物理可行。

- 视觉对齐:在 3D 点云中把人的手“抠掉”,把经过重定向的机械手“贴上去”。这样模型在预训练时,看到的就是机器人自己在操作的画面。

3. UniDex-VLA:全 3D 的大脑

不同于传统的 2D 图像输入,UniDex-VLA 采用了 Uni3D 作为编码器处理彩色点云。这种 3D 表征对于精细的接触建模(如按压喷雾瓶、插入剪刀)至关重要。

实验与结果:战绩斐然

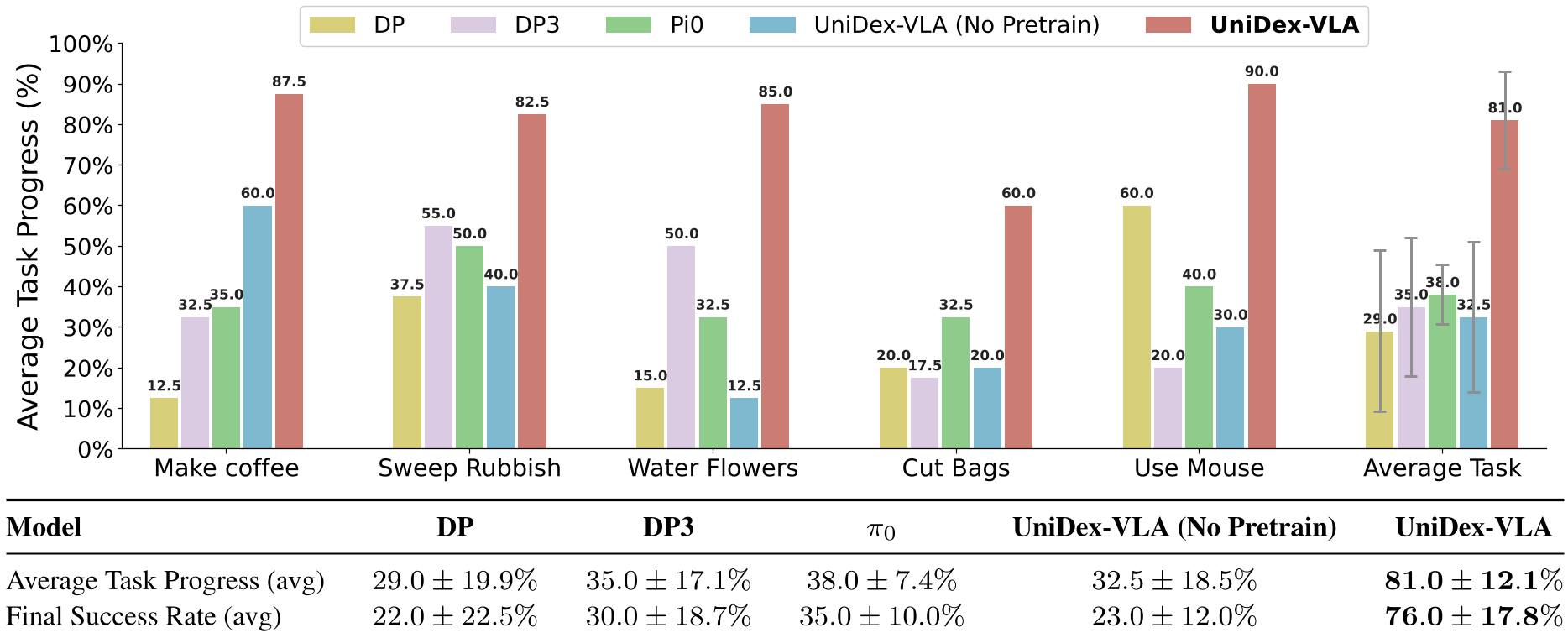

在“泡咖啡”、“剪袋子”、“用水壶浇花”等 5 个极具挑战性的任务中,UniDex-VLA 表现出惊人的性能:

- 平均进度 81%:在极少量的 Finetuning(仅 50 条数据)下,大幅超越了目前最强的基线 π0 (38%)。

- 1+1 > 2 的协训练:实验发现,2 条自动生成的模仿人类的数据可以抵消 1 条由于人工昂贵而短缺的机器人演示。

- 强大的泛化:即便换成从未见过的紫色小水壶,或者换一个全新的机械手硬件,模型依然能保持较高的成功率。

深度洞察与总结

UniDex 的成功在于它建立了一个标准化的“翻译官”角色。在硬件层面,FAAS 翻译了不同执行器的语言;在数据层面,重定向流水线翻译了人类与机器的动作逻辑。这种“统一化(Unification)”是大规模具身智能(Embodied AI)落地的必经之路。

局限性:目前系统仍需要少量的人工干预进行 IK 轨迹修复。未来的方向在于如何利用更加原始、无标注的“行为视频”大规模扩展模型的常识库。

对于开发者而言,UniDex-Cap 这种低成本(Apple Vision Pro + L515)的数据采集方案,或许将开启个人开发者训练灵巧机器人模型的新时代。