本文推出了 A1,一个全开源且透明的视觉-语言-动作(VLA)模型框架。该模型基于 Molmo VLM 主干,引入了预算感知型自适应推理机制和“层间截断流匹配”(Inter-Layer Truncated Flow Matching),在保持 SOTA 操控成功率的同时,大幅降低了计算延迟。

TL;DR

在机器人操控领域,Vision-Language-Action (VLA) 模型虽然强大,但其沉重的计算负担一直是大规模部署的“拌脚石”。来自中山大学、MBZUAI 等机构的研究团队推出了 A1 —— 一个兼具高效率与高性能的全开源 VLA 模型。它通过自适应推理早停和层间截断流匹配技术,实现了主干计算量 76% 的削减,同时在 RoboChallenge 榜单上刷新了开源模型的 SOTA 纪录。

痛点深挖:为什么 VLA 总是“慢半拍”?

当前的 SOTA VLA 模型(如 OpenVLA, π0)普遍面临两个效率黑洞:

- 臃肿的主干 (Backbone):为了获得强大的通识能力,模型必须背负数十亿参数的大文本模型(LLM),每一帧图像都要跑完几十层 Transformer。

- 贪婪的动作头 (Action Head):基于扩散模型或 Flow Matching 的动作头通常需要 10-20 次迭代去噪才能生成平滑轨迹,这直接导致了端到端的巨大延迟。

研究团队观察到,并非所有动作都需要深层语义,且连续帧之间的动作具有极强的相关性和冗余性。

核心技术:少花钱,办实事

A1 的核心贡献在于其“预算感知(Budget-aware)”的推理模式,重点解决了主干和动作头的耦合加速。

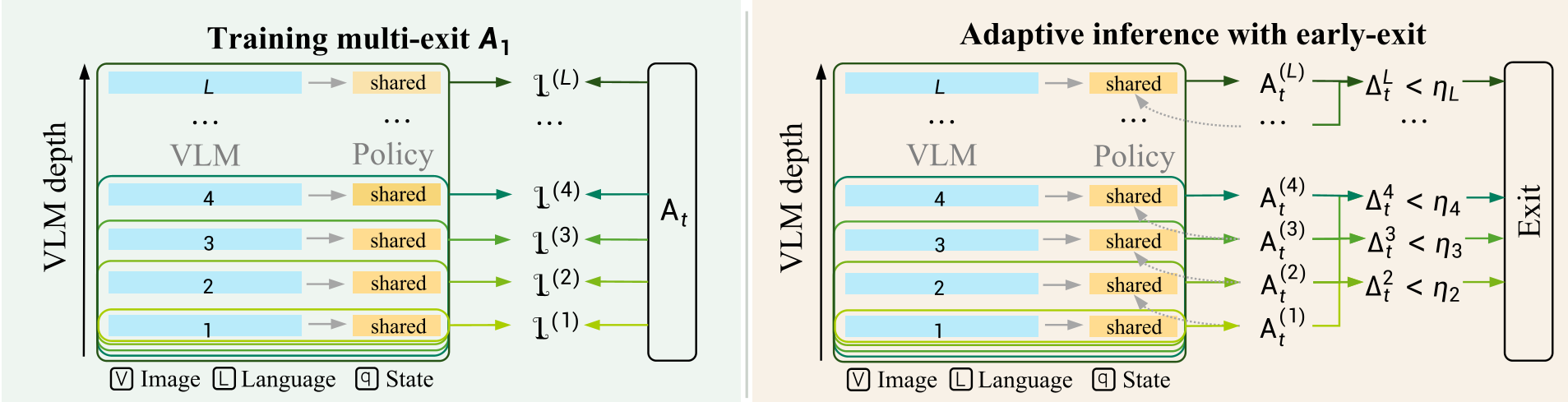

1. 动作一致性早停 (Early-Termination)

A1 不再死板地跑完 28 层 Transformer。每经过几层,模型就会尝试生成一个动作块(Action Chunk),并计算它与前一层输出的差异 $\Delta$。如果差异小于预设门阈 $\eta$,说明当前特征已足够支撑决策,模型立即“打卡下班”。

- 直觉:对于简单的平移,几层视觉特征就够了;只有遇到“开火倒水”等复杂交互,才需要深层推理。

2. 层间截断流匹配 (Inter-Layer Truncated Flow Matching)

这是 A1 最具灵性的设计。在传统的早停方案中,每层都要重新进行完整的去噪迭代,反而增加了开销。A1 提出了热启动 (Warm-start) 机制:

- 每一层只运行极少步数(如 $\delta=2$)的去噪。

- 下一层不再从随机噪声开始,而是直接继承上一层的去噪结果。

- 这种方式将原本纵向延伸的去噪过程巧妙地横跨在了 VLM 的层级结构中。

实验战绩:开源力量的胜利

在 RoboChallenge 这一极其困难的真实机器人基准测试中,A1 的表现令人惊艳:

- 平均成功率 29.00%,力压 π0 (28.33%) 和 RDT-1B (15.00%)。

- 在关键任务如“打开打印机”中达到 100% 成功率,“摆放杯子”达到 90%。

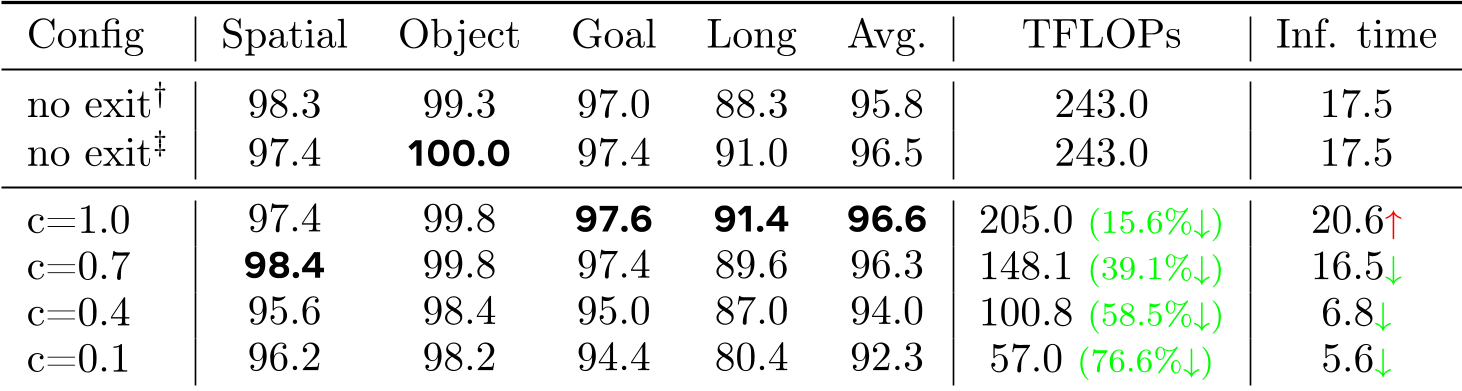

效率与性能的动态博弈 (Ablation)

实验数据展示了 A1 的弹性:即使在减少了 76.6% 的 LLM 计算量时,LIBERO 上的成功率仅从 96.6% 轻微下降至 92.3%。这意味着我们完全可以用更廉价的硬件跑出接近顶配的效果。

深度洞察与总结

A1 的出现标志着 VLA 研究从“单纯堆规模”向“精准效能优化”的转型。其全透明的开源策略(包括代码、检查点、数据流水线)为社区提供了极具价值的基准。

局限性分析: 尽管实现了巨大的加速,但 A1 的早停门阈目前还需要基于训练集进行离线定标。未来如果能实现端到端的实时自适应预测,其实用价值将进一步飞跃。

结语: “Spend compute only when it changes the action” —— 只有当计算能改变动作时,计算才有价值。A1 实践了这一朴素的哲学,为实时、低成本的通用机器人控制指明了方向。