本文提出了 ViewSplat,一种视图自适应的动态 3D Gaussian Splatting 网络,专门用于无相机位姿输入(Pose-free)条件下的前馈新视图合成。该方法通过引入场景调节的动态 MLP,实时预测高斯基元的残差更新,实现了在 154 FPS 渲染速度下的 SOTA 精度。

TL;DR

在 3D 重建领域,前馈(Feed-forward)方法因其无需逐场景优化的惊人速度而备受关注。然而,如何在不牺牲速度的前提下,捕捉到类似镜面反射的高频细节?本文介绍的 ViewSplat 给出了答案:它通过“视图自适应动态渲染”取代了传统的“静态基元回归”,在保持 154 FPS 实时渲染的同时,大幅提升了图像保真度。

背景定位

传统 3D Gaussian Splatting (3DGS) 依赖于耗时的逐场景优化(Per-scene Optimization)和预计算的 SfM 位姿。虽然近期出现了一些通用的前馈模型,但它们大多由于采用静态高斯基元,在面对非朗伯体表面(如反光地面、玻璃)时表现平平。ViewSplat 在无位姿(Pose-free)的 SOTA 基线 SPFSplat 之上,引入了动态修正机制,定位为追求极致渲染保真度的通用 3DGS 方案。

痛点深挖:静态表示的局限性

为什么前馈模型总是“差点意思”?

- 回归任务的病态性:用单次前馈去预测一个能满足所有潜在观察视角的 3D 表示极其困难。

- SH(球谐函数)的带宽限制:虽然 3DGS 使用 SH 来表达视角相关颜色,但实验证明单纯增加 SH 阶数对性能提升微乎其微。

- 缺乏纠错能力:静态模型在推理时无法根据观察视角的不同来修正初始的几何和外观估计误差。

核心方法论:View-Adaptive Dynamic Splatting

ViewSplat 的核心直觉在于:如果能根据观察视角量身定制 3D 基元,那么实现高保真渲染将变得简单得多。

1. 模型架构解析

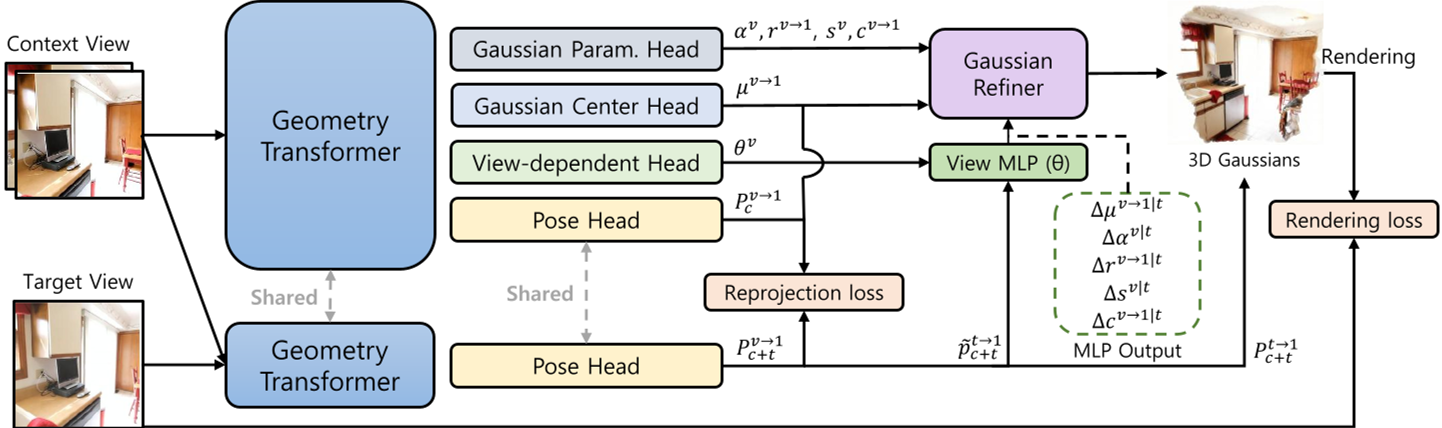

上图展示了 ViewSplat 的整体流程:从多视图输入到基础高斯预测,再到利用动态 MLP 进行视图相关的属性修正。

上图展示了 ViewSplat 的整体流程:从多视图输入到基础高斯预测,再到利用动态 MLP 进行视图相关的属性修正。

- 基础层(Base Layer):继承自 SPFSplat,负责生成初步的 3D 高斯基元和相机位姿。

- 视图自适应头(View-Dependent Head):这是一个超网络(Hypernetwork),它不直接输出属性,而是输出每个像素对应的 View MLP 的参数。

- 残差更新机制:在渲染时,View MLP 接收目标视图的 4D 重参数化位姿(包含方向和对数距离),输出针对位置 ($\Delta \mu$)、透明度 ($\Delta \alpha$)、旋转和缩放的残差。

2. 关键设计:对数距离参数化

作者发现,透视投影对近距离物体更敏感。因此,在输入 View MLP 时,采用了对数坐标尺度的距离,这使得网络能够更精准地捕捉近场中的视图变化细节。

实验与结果:统治级的性能

ViewSplat 在多个 benchmark 上展现了极其稳健的提升。

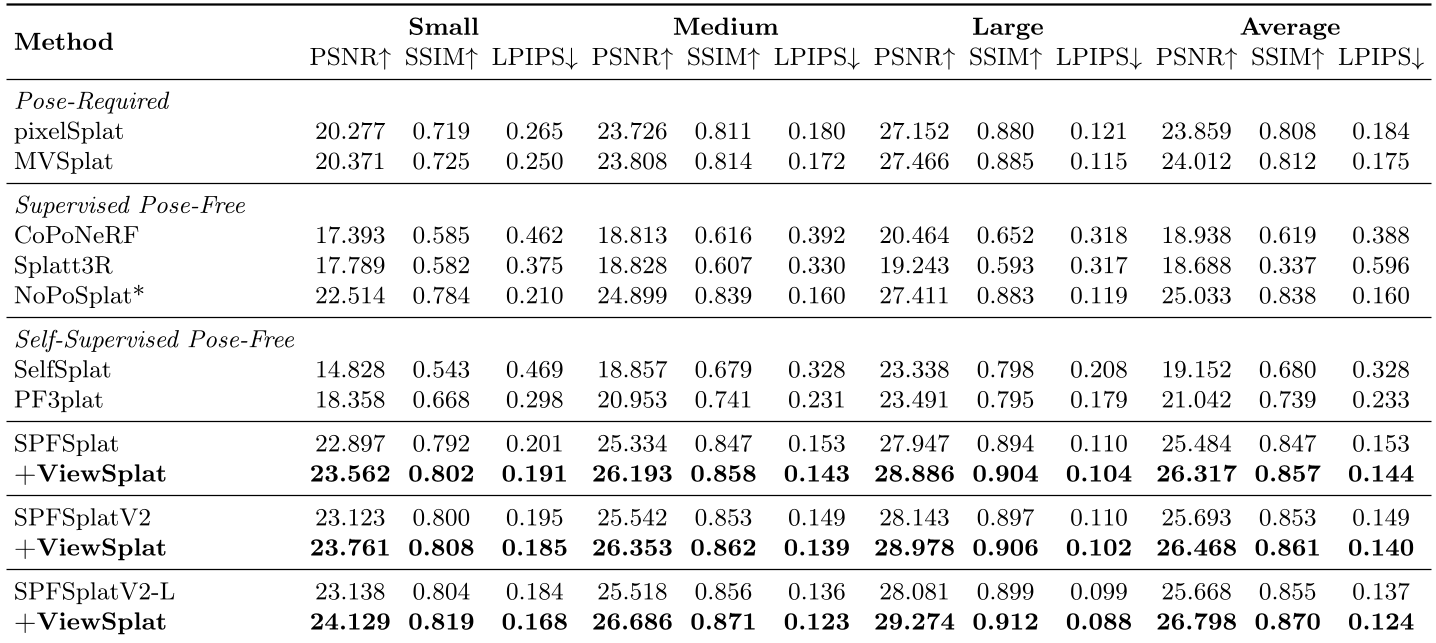

SOTA 对比

在 RE10K 数据集上,ViewSplat 在所有重叠度测试下均显著优于先前的 Pose-free 方法(如 NoPoSplat, SelfSplat)。

在 RE10K 数据集上,ViewSplat 在所有重叠度测试下均显著优于先前的 Pose-free 方法(如 NoPoSplat, SelfSplat)。

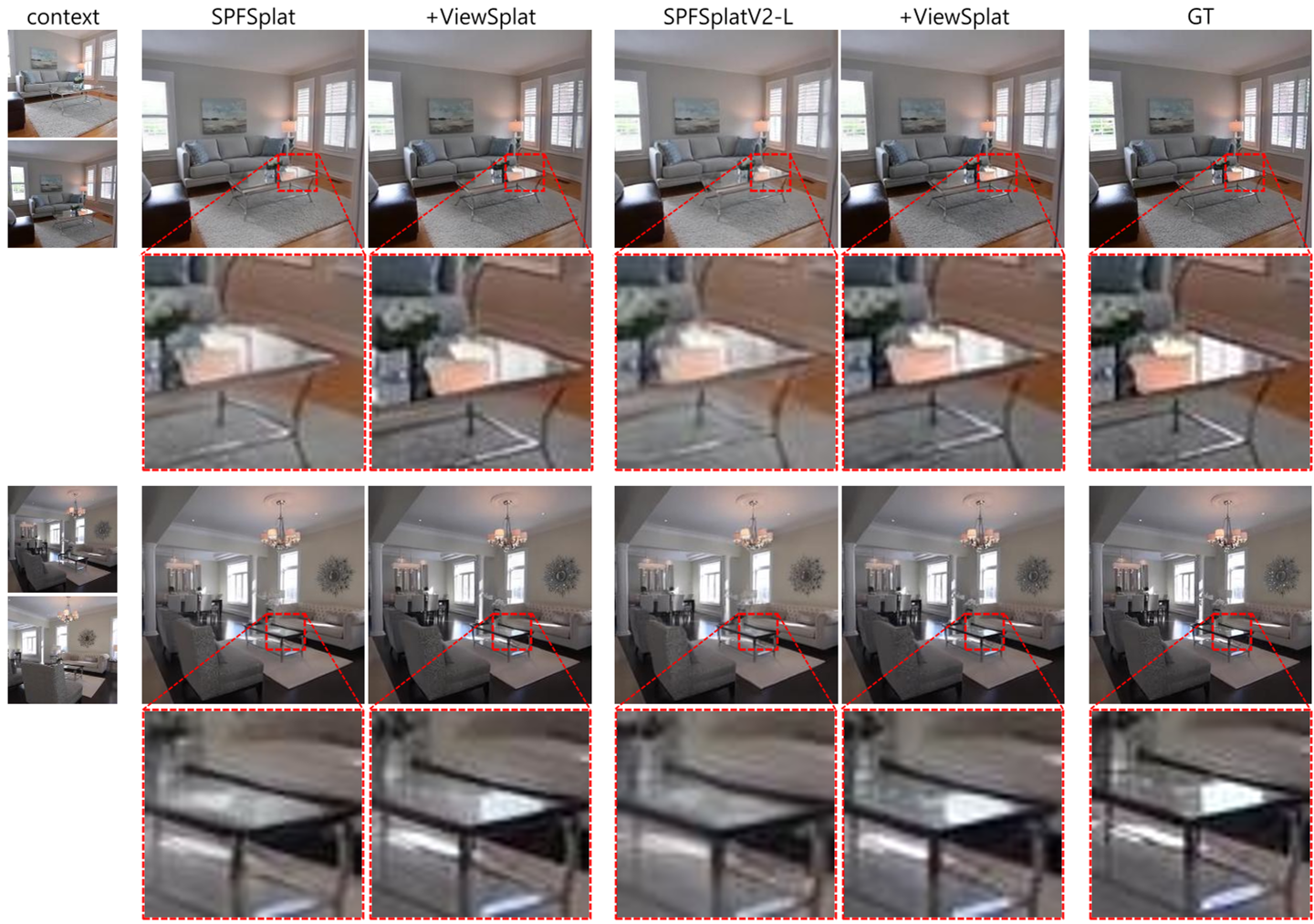

视觉效果

观察对比图可以发现,ViewSplat 能够还原出清晰的镜面反射和更锐利的边缘,修正了基线模型中常见的模糊和伪影。

观察对比图可以发现,ViewSplat 能够还原出清晰的镜面反射和更锐利的边缘,修正了基线模型中常见的模糊和伪影。

深度洞察与总结

核心价值 (Takeaway)

ViewSplat 的成功标志着通用 3D 重建从“学习静态世界”向“模拟动态观察过程”的转变。通过动态 MLP 进行属性修正,其本质是在推理阶段引入了一种极其轻量级的“微调”,用极小的计算开销(仅增加约 10ms 推理延迟)换取了显著的感知质量提升。

局限性

尽管渲染质量飞跃,但 ViewSplat 仍属于“重建式”模型,缺乏生成先验(Generative Priors)。这意味着在极稀疏的视角下,它无法像生成模型那样“幻构”出未观察到的面,会导致部分区域出现空洞。

结论

ViewSplat 证明了视图自适应机制是填补前馈模型与优化模型之间保真度鸿沟的关键拼图。对于需要在野外、无位姿环境下进行快速 3D 展示的应用(如电商、实景导航),这一技术框架具有极高的落地潜力。