本文推出了 AGILE,这是一个基于 Isaac Lab 和 RSL-RL 构建的类人机器人强化学习(RL)全流程工作流。它标准化了从环境验证、可重复训练、统一评估到描述符驱动部署的完整生命周期,在 Unitree G1 和 Booster T1 平台上实现了包括行走、站立恢复、运动模仿和双臂协作在内的五类 SOTA 技能的高效 Sim-to-Real 迁移。

TL;DR

在类人机器人领域,从成功的仿真实验到稳定的真机部署之间往往隔着一道“工程天坑”。NVIDIA 团队近期发布的 AGILE (A Generic Isaac-Lab based Engine) 不仅仅是一个算法库,它更是一套严谨的工程工作流。它通过标准化验证、训练、评估和部署四个阶段,解决了关节配置错误、策略逻辑不透明及硬件迁移困难等痛点,在 Unitree G1 和 Booster T1 上实现了高度鲁棒的运动表现。

痛点深挖:为什么你的机器人始终“走不出”仿真器?

类人机器人 RL 开发中存在两个典型的“无声杀手”:

- 工作流断层 (Workflow Gap):开发者经常在训练 24 小时后才惊讶地发现,某个关节的旋转方向配反了,或者奖励函数在特定接触下未触发。这种缺乏预验证的开发模式极大浪费了算力。

- 迁移断层 (Transfer Gap):仿真中的 Observation(观察空间)索引、Action(动作空间)缩放和历史缓存(History Buffer)在部署到 C++ 控制栈或真机驱动时,往往需要手动重写,极易引入隐性 Bug。

方法论详解:AGILE 的四大核心支柱

AGILE 将类人机器人开发重构为一个结构化的工程周期:

1. 预先验证 (Prepare & Verify)

AGILE 提供了一套交互式 GUI 插件,允许开发者在正式训练前,通过手动拖动滑块验证关节限位、通过奖励可视化器 (Reward Visualizer) 观察各项 Reward 的实时贡献。这种“所见即所得”的调试极大降低了 MDP(马尔可夫决策过程)配置错误的概率。

2. 算法增强库 (Algorithmic Toolbox)

为了提升 Sim-to-Real 的稳定性,AGILE 集成了多项关键技术:

- L2C2 正则化:强制策略满足局部双向 Lipschitz 连续性,使动作输出更平滑,避免真实电机产生高频抖动。

- 价值引导终止 (Value-Bootstrapped Terminations):解决“自杀式智能体”问题。当机器人跌倒时,不再赋予一个随机的负分惩罚,而是根据价值函数 进行 bootstrapping,使训练过程对奖励缩放不敏感。

- 虚拟腰带 (Virtual Harness):在训练初期给机器人施加一个虚拟的垂直力和平衡力矩,像学步带一样帮助模型渡过最初的“随机崩溃”阶段。

图 1: AGILE 整体工作流,复盖从环境调试到分布式训练再到真机部署的全过程。

图 1: AGILE 整体工作流,复盖从环境调试到分布式训练再到真机部署的全过程。

3. 解耦的全身控制 (Decoupled WBC)

文中提出了一个极具启发性的思路:上下肢解耦。 在训练行走策略时,下肢负责稳定,而上肢关节通过随机的速度曲线(Trapezoidal Velocity Profile)进行扰动。这种设计保留了上肢的自由度,使得部署时可以无缝接入 IK(逆运动学)控制器或 VLA(视觉-语言-动作)大模型进行复杂操作。

实验与结果:从行走、热舞到 VLA 控操

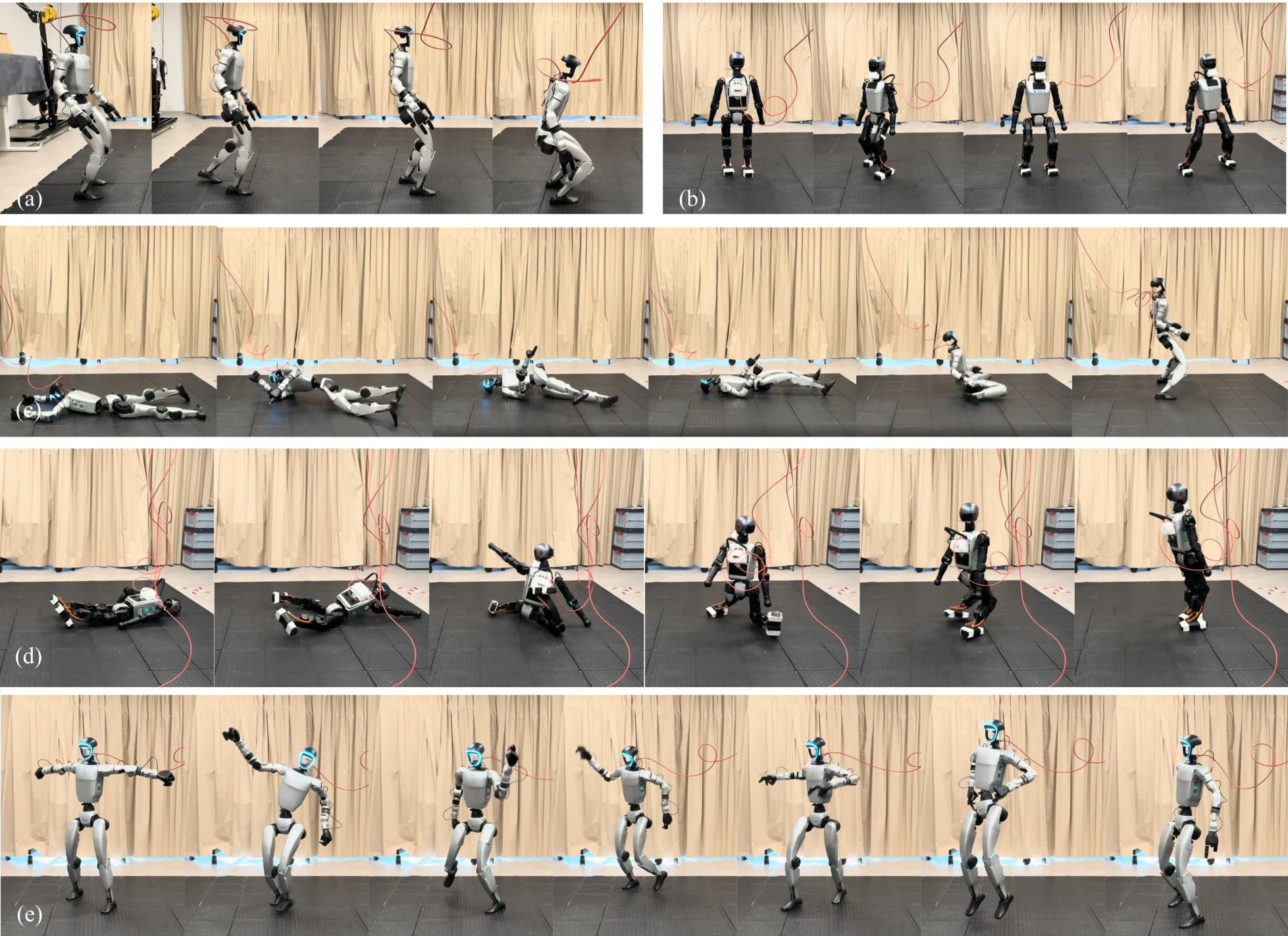

研究团队在 Unitree G1 和 Booster T1 上验证了五个具有代表性的任务。结果表明,AGILE 的确定性评估序列(Deterministic Scenarios)比传统的随机采样(Stochastic Rollouts)更能精准捕捉 joint limit violation 等硬件致命错误。

图 2: AGILE 在 G1 和 T1 两款机器人上实现的五类任务:(a-b) 速度/高度受控行走 (c-d) 跌倒起立 (e) 复杂舞蹈模仿。

图 2: AGILE 在 G1 和 T1 两款机器人上实现的五类任务:(a-b) 速度/高度受控行走 (c-d) 跌倒起立 (e) 复杂舞蹈模仿。

在全身控操 (Loco-manipulation) 任务中,作者展示了如何利用 RL 专家生成数据,进而微调 GR00T VLA 模型。最终,原本只具备本体感知的机器人通过接入视觉大模型,能根据语言指令完成“拾取并投放”任务,成功率高达 90%。

深度洞察:标准化的力量

AGILE 的成功并非来源于发明了某种全新的 RL 算法,而是它深刻理解了“鲁棒性源于每一处工程细节”。通过引入 I/O 描述符 (Descriptor) 系统,AGILE 确保了策略在导出后,无论是在 MuJoCo 里做 Sim-to-Sim 交叉验证,还是在真机上运行 Python/C++ 推理栈,其数据的物理含义和排列顺序始终保持绝对一致。

局限性分析: 虽然 AGILE 在感知层面的任务(如动态避障或复杂地形识别)提及较少,但它为这些高级行为构建了一个极其坚固的基础控制层。

总结 (Takeaway)

AGILE 的开源为社区提供了一个类人机器人开发的“标准样板间”。它告诉我们:与其在奖励函数里反复“炼丹”,不如先建立一套可靠的可视化验证和回归测试体系。对于志在实现 General-Purpose Humanoids 的开发者来说,这套工作流是缩短研发周期的必经之路。