本文提出了 MemCoT,一种通过内存驱动思索链(Memory-Driven Chain-of-Thought)实现的测试时扩展框架。它将长文本推理从静态的一次性检索转变为迭代的、有状态的活动搜索过程,在 LoCoMo 等长上下文基准测试中显著超越了 GPT-4o-mini 等强基线,创造了新的 SOTA 记录。

TL;DR

尽管 LLM 的上下文窗口已迈向百万量级,但在处理琐碎、散落的长信息时仍频繁出现“幻觉”和“灾难性遗忘”。东南大学与上海 AI Lab 的研究者提出了 MemCoT,核心思想是:不再把记忆当作静态的数据库,而是将其视为推理引擎。 通过迭代的“搜索-推理-更新”循环,MemCoT 让 GPT-4o-mini 等轻量化模型在长文本推理任务(LoCoMo)上超越了性能远强于它的重型基线。

痛点深挖:为什么简单的 RAG 救不了长文本?

目前主流的长上下文方案(RAG)依赖于“一次性被动匹配”:

- 语义稀释 (Semantic Dilution):在海量噪声中,预先定义的向量检索很难精准命中复杂的多跳逻辑点。

- 上下文碎片化 (Contextual Fragmentation):为了检索精准,切片(Chunk)往往很小,但这丢失了证据周围的因果语境;如果切片太大,又会引入过多噪声干扰推理。

作者认为,长文本推理本质上不是“容量问题”,而是**“信息搜寻策略问题”**。

Methodology:MemCoT 的核心机制

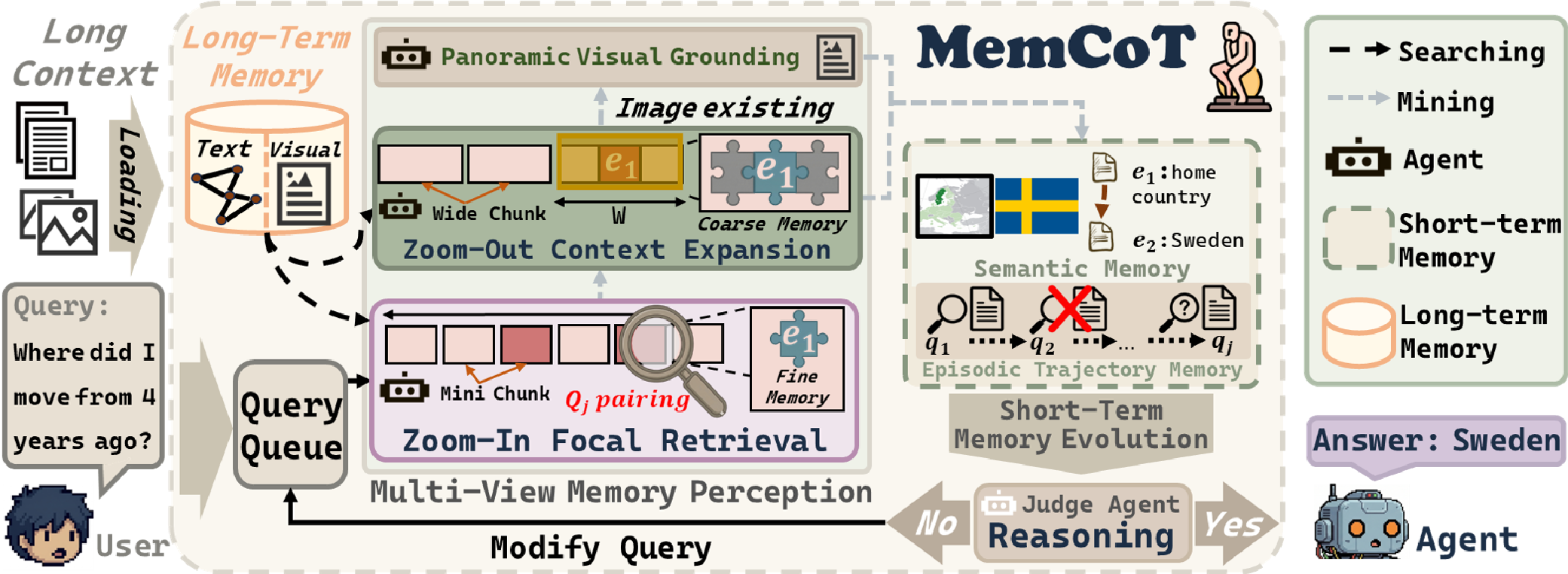

MemCoT 的架构设计(见下图)通过测试时扩展(Test-time Scaling),将单次前馈变为了多轮迭代。

1. 多视图长期记忆感知 (Multi-View Perception)

为了解决上述的颗粒度矛盾,MemCoT 采用了类似人类阅读的逻辑:

- Zoom-In (聚焦检索):利用实体索引进行高精度的微观定位。

- Zoom-Out (上下文扩展):在锁定关键点后,自动提取其周围的 个邻近切片。这种设计能有效恢复被切分掉的语义链条。

- Visual Grounding:如果是多模态任务,还会触发视觉锚定模块。

2. 短期记忆的“自进化”递归

MemCoT 维护了一个任务感知的状态内存:

- 语义状态内存:存储已检索到的事实。

- 轨迹记忆 (Episodic Trajectory):记录失败的搜索路径。 Judge Agent 会判断当前证据是否足以回答问题。如果不足,它会通过 分解(Decomposition) 和 剪枝(Pruning) 机制更新 Sub-query,开启下一轮迭代。

实验与结果:小模型的逆袭

MemCoT 最令人印象深刻的战绩是它对轻量级模型的赋能。

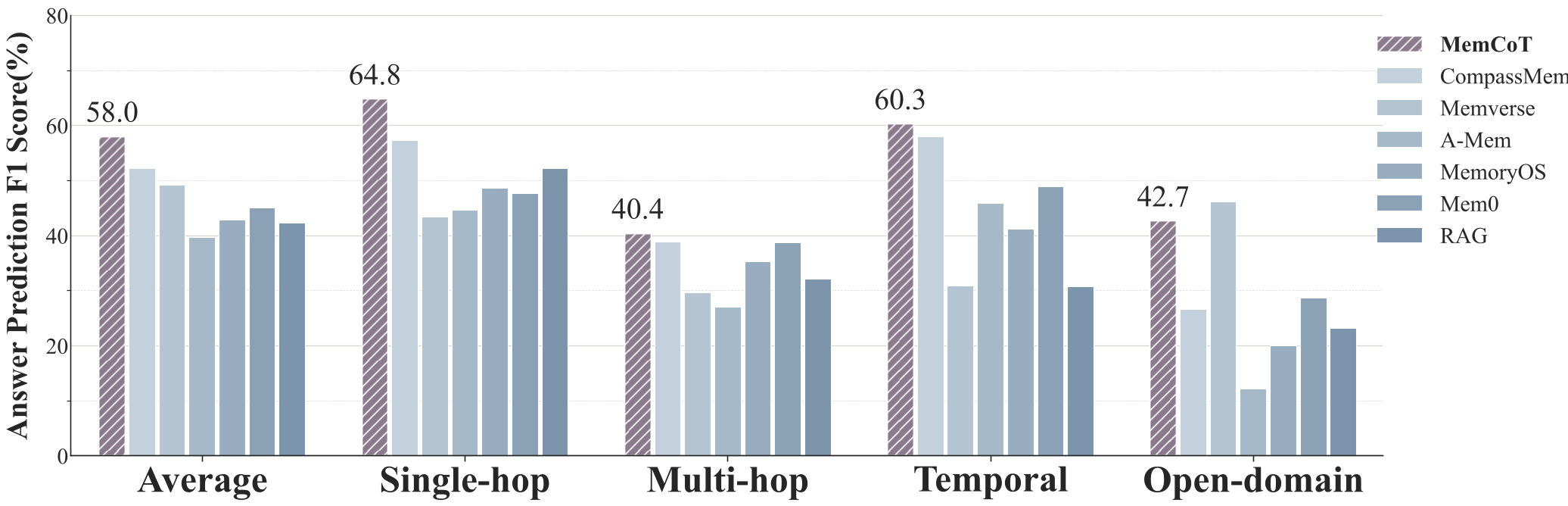

在 LoCoMo 这一严苛的长对话推理基准上:

- GPT-4o-mini + MemCoT 获得了 58.03% 的 F1 分数,不仅刷新了记录,还在 Open-domain 和 Temporal(时间推理)子项中大幅领先。

- Qwen2.5-7B 这种参数量级的模型,在引入 MemCoT 后,各子项表现均有翻倍式的增长(从 28.75 升至 52.01)。

关键洞察:相邻窗口(W)的影响

实验显示(见图 4a),并不是扩展窗口越大越好。当 超过 8 时,虽然查全率(Recall)趋于平稳,但由于噪声(Semantic Noise)的增加,F1 分数反而下降。这再次印证了长文本处理中“信噪比控制”的重要性。

深度洞察与总结

MemCoT 的价值在于其“可追踪”与“可纠错”。 传统的 CoT 是 LLM 内在推理能力的挖掘,而 MemCoT 将这种 Chain-of-Thought 延伸到了外部存储空间,形成了 Memory-driven CoT。

- 局限性:由于涉及多轮迭代,其推理延迟(Latency)会高于单次 RAG。虽然论文证明了平均迭代步数仅为 1.87 步,但在实时交互场景中仍需优化。

- 未来展望:这种“以计算换智能”的思路与最近火热的 OpenAI o1 模型异曲同工。未来,这种自进化的记忆访问机制可能会成为 Agent 系统的标准配置,使其具备处理“跨度长达数月、逻辑极度繁琐”任务的能力。

Takeaway: 记忆不应只是一个仓库,它应该是推理路径的一部分。MemCoT 通过迭代状态搜索,成功将长上下文处理的瓶颈从容量转向了策略。