本文推出了 AirVLA,这是首个将预训练视觉-语言-动作(VLA)模型(基于 π0)迁移至空中机器人(无人机)进行操纵任务的系统。通过引入物理感知引导机制和基于高斯泼溅(Gaussian Splatting)的数据增强,成功在欠驱动的 6-DoF 飞行平台上实现了导航、抓取及复杂组合任务。

TL;DR

视觉-语言-动作 (VLA) 模型已经在地面机械臂上大放异彩,但由于飞行器极其复杂的动力学特性,如何让这些“大脑”控制无人机一直是个难题。AirVLA 首次证明了:通过在推理时注入物理感知引导(Physics-Guided)并辅以 3D 高斯泼溅(Gaussian Splatting)合成数据,基于传统机械臂预训练的 模型也能完美适配无人机,完成导航、抓取及两者组合的复杂任务。

1. 痛点:准静态大脑 vs. 动力学飞手

当前的机器人基础模型(如 RT-2, )虽然见过成千上万种抓取,但它们大多是“坐着工作的”——基于固定的机械臂底座,操作环境属于准静态(Quasi-static)。

当我们将这类模型直接搬到无人机上时,会遭遇三大挑战:

- 欠驱动特性 (Underactuation):推力与姿态耦合,微小的动作预测误差可能导致坠毁。

- 载荷突变 (Payload Disturbance):当无人机抓住一个物体时,总质量突增,如果不及时补偿,飞机会迅速下坠导致任务失败。

- 视觉漂移:机载摄像头随飞行大幅晃动,这与桌面操纵的稳定视角迥异。

2. 核心架构:AirVLA 的桥接之道

作者基于 ModalAI Starling 2 Max 无人机打造了 AirVLA。其核心工作流程包括:输入多视角 RGB 图像与自然语言指令,通过微调后的 输出动作块(Action Chunk)。

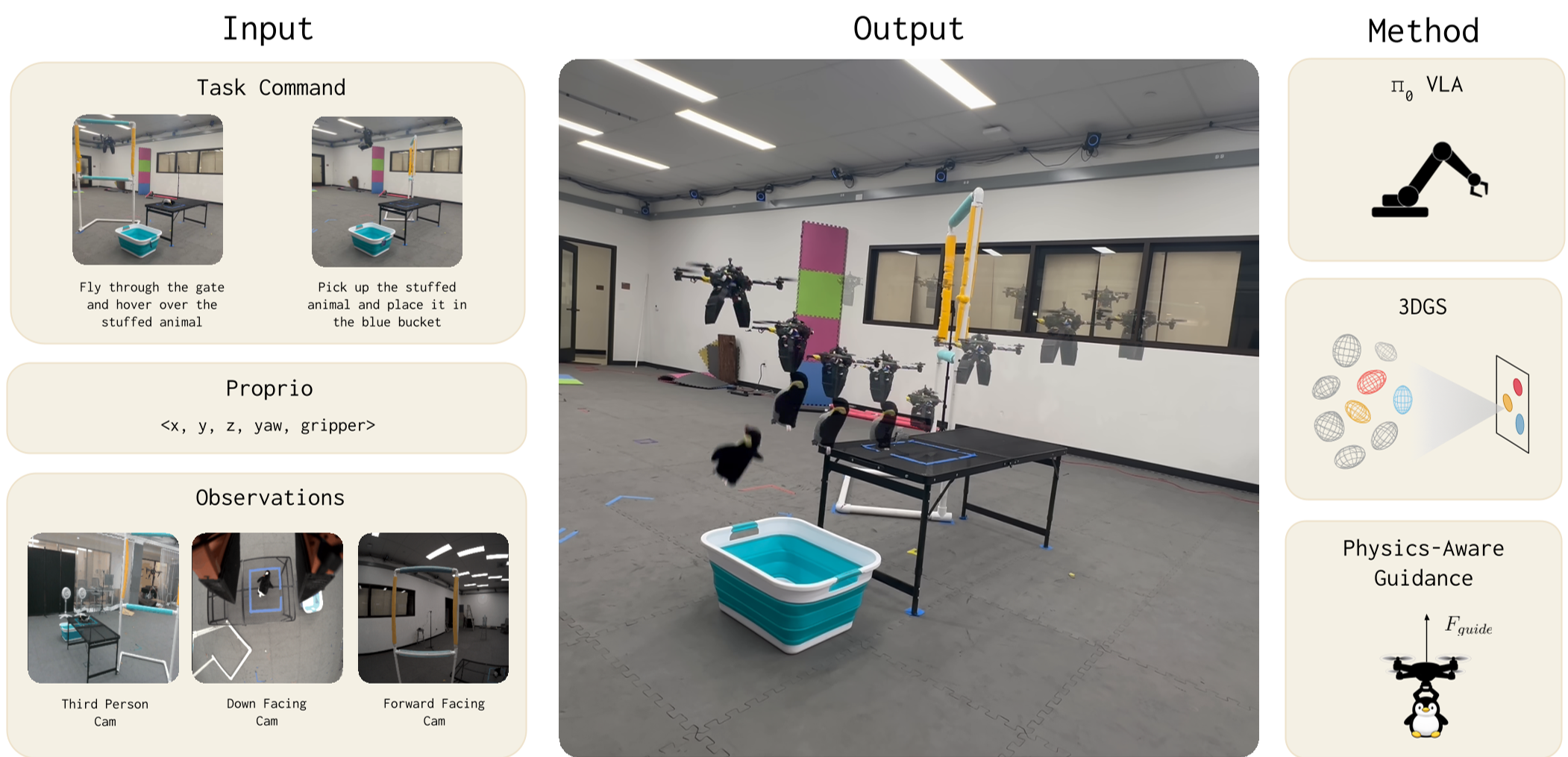

图 1: AirVLA 系统架构。左侧为多模态输入,右侧为带物理引导的动作生成。

图 1: AirVLA 系统架构。左侧为多模态输入,右侧为带物理引导的动作生成。

2.1 物理感知引导 (Payload-Aware Guidance)

作者没有尝试去重新训练庞大的 VLA 模型来学习复杂的流体力学,而是在推理采样阶段动了手脚。

利用 的 Flow-matching 采样特性,在每一步迭代中注入一个损失函数 的梯度。针对无人机抓取,作者设计了一个专门的 垂直高度补偿项: 其中 是根据当前夹具状态(是否闭合、是否有负载)动态计算的修正量。当系统检测到正在抓取物体时,强制将动作向“上方”拉偏,抵消重力下坠。

2.2 3DGS 合成加速数据产生

空中机器人的数据采集极其昂贵且伴随炸机风险。团队利用 3D Gaussian Splatting (3DGS) 重建了实验环境,并在此虚拟空间内合成大量纠偏轨迹。为了确保视觉真实性,他们甚至专门处理了机载夹具的遮挡掩码(Mask),让模型在仿真数据中学到的视觉表征在实操中无缝切换。

3. 实验结果:VLA 的惊人迁移力

团队进行了总计 460 次真实飞行实验,结果非常硬核:

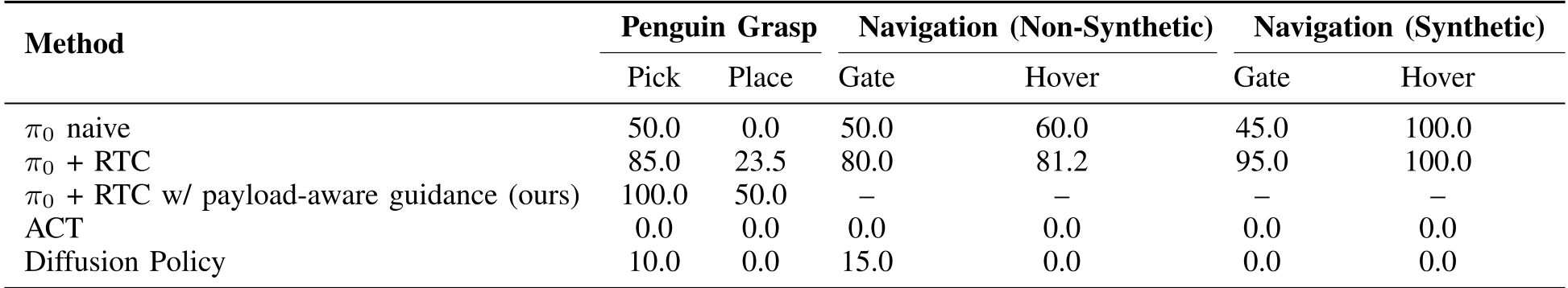

- 物理引导的威力:在“抓取并放置”任务中,加入 Payload-Aware Guidance 后,成功率从基线的 23% 直接翻倍至 50%。

- 组合任务成功:在从未训练过的“穿越障碍门然后再抓取”任务中,模型表现出了极强的零样本(Zero-shot)逻辑能力,条件成功率达 62%。

- 物体泛化:即便预训练和微调主要基于“企鹅公仔”,模型仍能成功抓取三明治(成功率 57%)等从未见过的 OOD 物体。

表 1: 不同配置下的性能对比。可以看到 RTC(实时块生成)与引导机制对无人机至关重要。

表 1: 不同配置下的性能对比。可以看到 RTC(实时块生成)与引导机制对无人机至关重要。

4. 深度洞察与总结

AirVLA 给我们的核心启示在于:基础模型的表征力是通用的,但物理交互必须是个性化的。

- 表征与语义的通用性:哪怕是针对地面机械臂训练的 ,也已经识别出了“抓取”和“物体”之间的深层关系,这份知识是可以跨越具身(Embodiment)的。

- 物理感知的必要性:对于欠驱动、高动态的系统,单纯依赖数据驱动的微调是不够的。在模型的采样回路中(Loop)引入经典的控制理论或物理约束,是实现复杂机器人控制的高效路径。

局限性:虽然 AirVLA 迈出了第一步,但目前的空间泛化仍有提升空间(换个位置的门,成功率会下降),这暗示了小规模微调在导航任务中仍存在过拟合问题。未来的方向可能是将更大规模的空中特种数据(如无人机 FPV 竞技数据)引入 VLA 的预训练阶段。

参考文献: Tucker, J., & Sun, J., et al. (2024). π, But Make It Fly: Physics-Guided Transfer of VLA Models to Aerial Manipulation. https://airvla.github.io