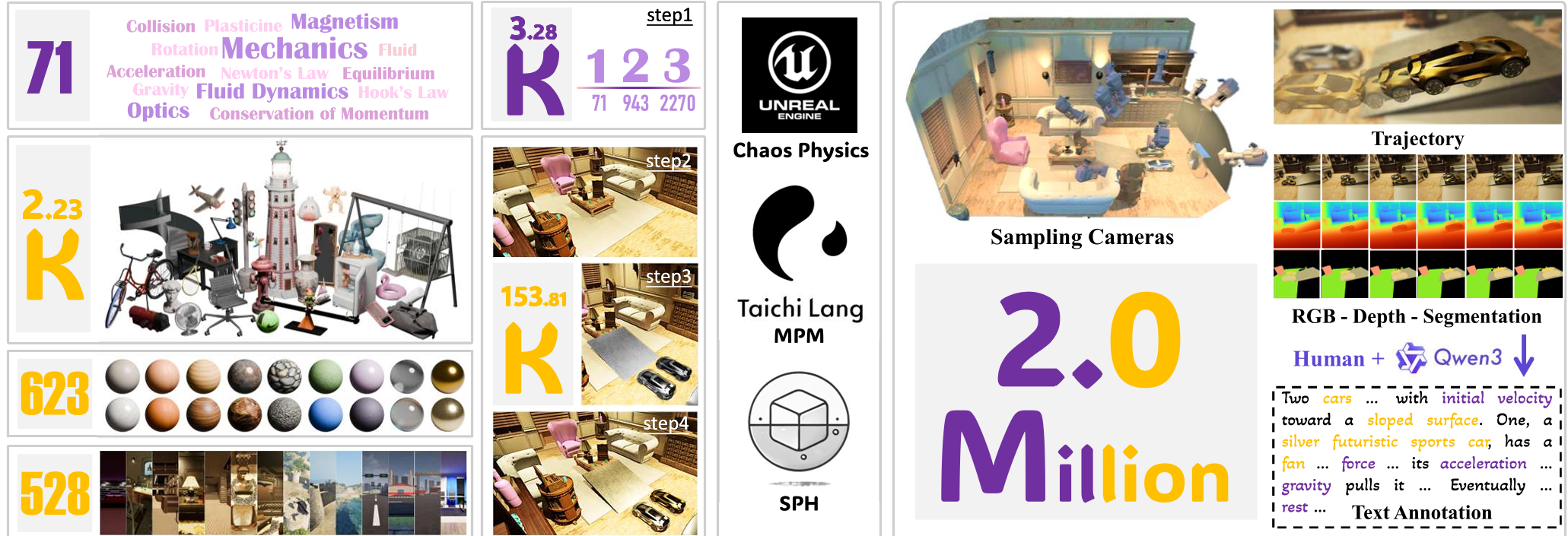

本文推出了 PhysInOne,这是一个大规模物理基础合成数据集,包含 200 万个视频和 15.3 万个动态 3D 场景。该套件涵盖力学、光学、流体力学和磁学四大领域的 71 种物理现象,是目前该领域规模最大、涵盖物理规律最全的数据集。

TL;DR

尽管当前的视频生成模型(如 Sora、SVD)在视觉效果上令人惊艳,但它们经常在“物理常识”上翻车:物体无故漂浮、碰撞不守恒、液体流动诡异。本文提出的 PhysInOne 是目前全球规模最大的视觉物理学习套件,包含 200 万个视频,涵盖 71 种物理现象。通过深度标注物体的内在物理属性,它能够显著提升 AI 模型对物理规律的模拟精度,是开发“世界模型”不可或缺的基石。

痛点深挖:AI 为何不懂“天下掉苹果”?

现有的基础模型(Foundational Models)大多是在互联网的海量视频上训练的。虽然数据量大,但这些视频缺乏精确的物理标签(如物体的弹性模量、摩擦系数、流体粘度等)。正如理查德·费曼所说:“我不能创造的,我就不理解。” 如果模型只是在模仿像素的变动,而没有理解背后的偏微分方程,它永远无法真正模拟现实。

此前的工作如 CLEVRER 或 Physion 规模太小(仅几千个案例),且环境过于单一(只有球、方块)。PhysInOne 的出现正是为了填补这一空白,将物理学习从“幼儿园水平”提升到“大学基础物理”水平。

核心方法论:多物理场驱动的场景生成

PhysInOne 的模型构建遵循严密的物理逻辑:

- 四大学科覆盖:力学(Mechanics)、光学(Optics)、流体力学(Fluid Dynamics)、磁学(Magnetism)。

- 物理规律引擎:利用 UE5 Chaos Physics 处理刚体,使用 Taichi MPM 模拟可变形体和粉末,使用 SPH 模拟液体。

- 多层级活动(Multiphysics):作者不仅模拟单一现象,还设计了“混合场景”。例如,一个正在加速的赛车(力学)撞击墙壁,反射了激光(光学),并掉入水中(流体力学)。

图 1:PhysInOne 从 71 种基本物理现象出发,扩展到 3284 种多物理活动,构筑了复杂的 3D 模拟场景。

图 1:PhysInOne 从 71 种基本物理现象出发,扩展到 3284 种多物理活动,构筑了复杂的 3D 模拟场景。

四大前沿应用验证

1. 物理感知视频生成

作者通过对 SVD、CogVideoX 和 Wan2.2 进行微调,发现注入 PhysInOne 数据后,模型生成的视频在碰撞和运动轨迹上更加真实。

- 创新指标 PMF:为了量化物理真实性,作者放弃了传统的像素对比,提出了基于傅里叶变换的频率能量指标。

2. 未来帧预测

模型需要根据前 2 秒视频预测后 2.6 秒发生了什么。实验显示,目前的模型在已知视角下表现尚可,但在**新视角(Novel View)**下预测物理动态能力依然薄弱。

3. 物理属性估计(系统辨识)

这是一项“逆物理”任务:AI 能否通过看一段物体落地的视频,猜出它的 Young's Modulus(杨氏模量) 或 Viscosity(粘度)?

图 2:重模拟实验显示,虽然模型能猜出大概,但在复杂背景和非典型物体上,预测精度仍有待提高。

图 2:重模拟实验显示,虽然模型能猜出大概,但在复杂背景和非典型物体上,预测精度仍有待提高。

4. 运动迁移(Motion Transfer)

尝试将一段特定的物理运动从源视频迁移到目标图片上。结果发现,即便视觉上很协调,现有的方法依然难以处理多物体交互时的复杂物理约束。

深度洞察与总结

PhysInOne 最宝贵的价值在于它不仅提供了“看”的视频,还提供了“想”的逻辑。通过 200 万段带有精准物理描述的文本标注,它实际上在教 AI 如何用语言描述物理演变,并将这种描述转化为像素的运动规律。

局限性:虽然涵盖了 71 种现象,但尚未包含热力学和声学(因为这些在视觉上不直观),且合成数据与现实世界的“Sim-to-Real Gap”依然存在。

展望:随着 PhysInOne 数据集的开源,我们距离真正的“数字孪生”和能够预测物理危险的具身机器人的未来又近了一步。